Wollen Schulen sich für die Herausforderungen und Chancen rund um KI bereit machen, sollte planvolle Schulentwicklung im Fokus stehen. In der momentanen Entwicklungsphase geht es aber zugleich um die grundsätzliche Haltung gegenüber Innovationen, das Kennenlernen und Ausprobieren, das Abschätzen künftiger Potentiale, die kritische Positionierung zu Chancen und Gefahren von Künstlicher Intelligenz – eben die ‚4A‘. Und dieses praktische Ausprobieren prägt auch den momentanen Hype um immer neue „KI“-Anwendungen und ihre – teils simplen, teils erstaunlichen – technischen Möglichkeiten.

Beginnen Schulen mit systematischen Überlegungen jetzt und parallel zur teils chaotischen technischen Entwicklung, wird es künftig sicherlich deutlich einfacher sein, neue Technologien einzuschätzen und für das Lernen zu nutzen, zugleich aber auch den kritischen Diskurs darüber anzuregen. Nehmen Schulen diesen Bildungsauftrag ernst, kann das nur durch Nutzung und Thematisierung in allen Schulfächern gelingen – auch wenn wir momentan gerade mit Blick auf KI noch viele Paradoxien in der Schulpraxis erleben.

Zugleich empfiehlt Beat D. Honegger in seinem programmatischen Vortrag „Wenn ChatGPT in der Lehrer:innenbildung mitredet“ völlig zurecht „einen Schritt zurückzutreten und zu überlegen, was diese Entwicklungen längerfristig bedeuten“, also weniger Versions- („Kennst Du schon die neue Version von ChatGPT“?) und Produktwissen („Kennst Du schon die neueste App?“), sondern vielmehr Konzeptwissen zu fokussieren.

Dieses Konzeptwissen sollte nicht nur von individuellen Eindrücken, in Online-Communities artikulierten (vermeintlichen) Selbstverständlichkeiten oder persönlichen, nicht hinterfragten Überzeugungen, sondern vielmehr von wissenschaftlicher Evidenz geprägt sein. Und dieser Frage möchte ich mit diesem Blogbeitrag fortlaufend nachgehen. Das ist mit Blick auf LLM/KI momentan noch schwierig, da gerade die erste Studienwelle rund um das Lernen mit KI läuft. Zugleich ist die Mehrzahl der Schulen noch gar nicht auf dem Stand, wissenschaftlich mit Blick auf KI-Implementierung begleitet zu werden. Dennoch, erste Anhaltspunkte und Tendenzen lassen sich schon jetzt aus laufenden Forschungsvorhaben gewinnen – ein interessanter Einblick in spannende Fragestellungen bietet sich allemal.

-

- Joscha Falck hat speziell zu diesem Thema einen fortlaufend aktualisierten und lesenswerten Überblick „KI-Forschung rund um Schule und Unterricht“ zusammengestellt.

In diesem Blogbeitrag möchte ich vor allem Studien sammeln, die sich rund um

-

- KI als „Sparringspartner“ mit Fokus auf Ko-Kreation von Mensch und Maschine sowie

- die Entwicklungsfelder Lernbegleitung / Feedback / Tutorsysteme (und damit neben der Qualität von Antworten auch die Mensch-Maschine-Interaktion an sich in den Blick nehmen) bewegen.

Teils bieten die hier aufgeführten Studien aber auch nur Anhaltspunkte indirekter Art zu wichtigen Fragen, die uns in Schule und Unterricht bewegen – zum Beispiel zur Frage nach der empfundenen „Empathie“ maschinellen Feedbacks – und deren Implikationen für Unterrichtsentwicklung.

Stand: Januar 2025

18.01.2025 – Studie zur „Leistungsfähigkeit von Large Language Modellen bei der (Positiv-)Korrektur von spanischsprachigen SchülerInnentexten“ (Lea Rettig, Universität Hannover)

Die Studie „Überprüfung der Leistungsfähigkeit von Large Language Modellen bei der (Positiv-)Korrektur von spanischsprachigen SchülerInnentexten. Eine empirische Studie“ untersucht, wie effektiv Large Language Models (LLM) wie ChatGPT und das darauf aufbauende KI-Korrektur-Tool von Fobizz im Vergleich zu Lehrkräften bei der Korrektur und Positivkorrektur von Schülertexten im Fach Spanisch arbeiten. Die Ergebnisse der Studie, erstellt von von Lea Rettig im Rahmen ihrer Masterarbeit an der Leibniz Universität Hannover, zeigen, dass KI-Modelle wie ChatGPT eine vielversprechende Ergänzung im Fremdsprachenunterricht sein können. Das gilt insbesondere zur Entlastung bei zeitaufwändigen Aufgaben wie der Korrekturarbeit und mit Blick auf lernförderliches Feedback. Gleichzeitig bleibt aber auch in dieser Studie die Erkenntnis zentral: Menschliche Lehrkräfte sind unverzichtbar, um die spezifischen sprachlichen, kulturellen und pädagogischen Anforderungen einer Positivkorrektur zu erfüllen. Die Zusammenarbeit zwischen Lehrkraft und Technologie könnte aber die Qualität und Effizienz des Fremdsprachenunterrichts erheblich steigern. Schauen wir doch gemeinsam in einige der Kernergebnisse:

1. Effizienzsteigerung

Lehrkräfte benötigen im Durchschnitt deutlich mehr Zeit zur Korrektur von Schülertexten als KI-Modelle. Die Studie zeigt, dass ChatGPT eine Korrektur innerhalb von wenigen Sekunden bzw. Minuten durchführen kann, während Lehrkräfte im Durchschnitt bis zu 15 Minuten pro Text benötigen, abhängig von der Komplexität des Textes und der Anzahl der enthaltenen Fehler. Daraus folgt ganz grundlegend, dass KI-Modelle Lehrkräfte bei der Korrekturarbeit erheblich entlasten können, insbesondere bei großen Klassen oder intensiven Korrekturphasen.

2. Qualität der Korrektur

ChatGPT konnte etwa 80 % der grammatikalischen Fehler korrekt identifizieren und lösen. Allerdings zeigte die KI Schwächen bei der Erkennung kontextbezogener Fehler, wie z. B. stilistische oder semantische Unstimmigkeiten. Menschliche Lehrkräfte identifizierten im Schnitt ca. 90 % der Fehler (hier gab es allerdings eine größere Bandbreite der Fehlererkennung) und gaben spezifischere Rückmeldungen, insbesondere bei schwierigen Fehlerarten. Auch hier zeigt sich: Obwohl KI-Modelle eine solide Grundkorrektur bieten, bleibt die Rolle der Lehrkraft zentral, insbesondere bei der Bewertung komplexer sprachlicher oder kulturell-spezifischer Aspekte.

Persönliche Anmerkung: In meinen Augen hängt mit Blick auf die Rechtschreib- und Grammatikkorrektur die Bewertung dieses Items aber stärker davon ab, welche Rolle die genaue Fehlerkorrektur im Lernprozess überhaupt haben soll. Denn je nach Fokus der Fehlerkorrektur sind die Erkennungsraten von ChatGPT hier bereits ausreichend für lernförderliches Feedback.

3. Motivation der Schülerinnen und Schüler durch Positivkorrekturen

Die Positivkorrekturen von ChatGPT und Fobizz waren oft abstrakt und generisch, während Lehrkräfte spezifische Stärken und Schwächen präzise benannten. Lehrkräfte hoben in 95 % der Fälle konkrete positive Aspekte hervor, während KI-Modelle dies nur in 65 % der Fälle spezifisch umsetzen konnten. Das zeigt: Positivkorrekturen, die gezielt auf gelungene Passagen eingehen, können das Selbstvertrauen und die Motivation der Schülerinnen und Schüler stärken. Die Studie betont, dass KI-Modelle hier eine Ergänzung bieten, jedoch spezifisch formulierte Prompts benötigen, um aussagekräftige Ergebnisse zu liefern.

Persönliche Anmerkung: Das ist letztlich auch eine Frage des Prompt-Engineerings im Hintergrund solcher Plattformen und kann zum Problem werden, wie eine kürzlich veröffentlichte sehr kritische Studie mit Blick auf die fobizz-Korrekturhilfe und deren Einordnung seitens fobizz zeigen.

4. Individuelle Förderung

Die KI zeigte sich in der Lage, Fehlerkategorien wie Grammatik, Wortwahl oder Rechtschreibung zuverlässig zu erkennen, wenn die Prompts entsprechend präzise formuliert wurden. Bei allgemeiner gehaltenen Anweisungen fielen die Ergebnisse jedoch deutlich weniger differenziert aus. Das macht deutlich: KI-Modelle können die Individualisierung im Unterricht unterstützen, indem sie Lernenden erste Hinweise auf Verbesserungen geben. Lehrkräfte müssen jedoch sicherstellen, dass die Prompts auf die spezifischen Bedürfnisse der Schüler abgestimmt sind.

Meine Einschätzung nach Lektüre der Studie:

Die Studie von Lea Rettig zeigt, dass ChatGPT ein erhebliches Potenzial besitzt, lernförderliches und positives Feedback im Fremdsprachenunterricht zu unterstützen, allerdings mit klaren Einschränkungen. ChatGPT erwies sich als äußerst effizient, indem es Fehler wie fehlende Akzente („esta“ statt „está“) oder falsche Verbformen („nosotros va“ statt „nosotros vamos“) in durchschnittlich weniger als zwei Minuten identifizierte und korrigierte – eine Aufgabe, für die Lehrkräfte oft bis zu 15 Minuten benötigen.

Im Bereich der Positivkorrektur zeigte sich jedoch eine Schwäche: Während ChatGPT häufig allgemeine Rückmeldungen wie „Der Text hat eine gute Struktur“ oder „Du verwendest interessante Wörter“ formulierte, lieferten Lehrkräfte konkretere und kontextbezogene Kommentare. Zum Beispiel lobten sie spezifisch: „Deine Einleitung ist gelungen, weil sie den Leser neugierig macht.“ Zudem waren die Rückmeldungen der Lehrkräfte sprachlich klarer und auf Schülerniveau formuliert, was ChatGPT in einigen Fällen nicht vollständig erreichte.

Insgesamt hat ChatGPT also schon jetzt das Potenzial, Lehrkräfte zu entlasten und erste, automatisierte Rückmeldungen zu geben. Um jedoch wirklich zuverlässig lernförderlich zu wirken, müsste die KI in der Lage sein, detailliertere, auf den individuellen Text bezogene Positivkorrekturen zu erstellen. Eine Kombination aus ChatGPT zur Grundkorrektur und der Lehrkraft zur differenzierten Feedbackgestaltung könnte daher ein vielversprechender Ansatz für den Fremdsprachenunterricht sein – das deckt sich mit zahlreichen weiteren Studien, die ich auch in diesem Blogbeitrag aufführe.

Schade ist, dass in der Studie „nur“ ChatGPT und das fobizz-Korrekturtool vergleichend analysiert werden. Besonders interessant wäre ein Vergleich mit FelloFish (das frühere FieteAI), das im Hintergrund auf offensichtlich sehr fundiertem Prompt-Engineering aufbaut. Denn einige der in der Studie negativer bewerteten Aspekte werden von FieteAI (rein subjektive Erfahrung aus der Unterrichtspraxis) bereits gut gelöst (spezifisches Feedback mit Textbeispielen, konkretes Feedback auf den Lernprozess etc.). Da freut es mich, dass aktuell bei uns in der Schule genau zu dieser Frage (Lehrerfeedback vs. FieteAI) eine Forschungsarbeit entsteht, deren Ergebnisse die Studie von Lea Rettig sicherlich sinnvoll ergänzen werden.

👉 Hier geht es zur Studie „Überprüfung der Leistungsfähigkeit von Large Language Modellen bei der (Positiv-)Korrektur von spanischsprachigen SchülerInnentexten“

12.01.2025 – Neue Meta-Studie: „Does ChatGPT enhance student learning? A systematic review and meta-analysis of experimental studies“

Die im Dezember 2024 veröffentlichte neue Meta-Studie von Ruiqi Deng, Maoli Jiang, Xinlu Yu, Yuyan Lu und Shasha Liu liefert interessante Erkenntnisse zur Integration von ChatGPT in den Bildungsbereich, ist aber mit Blick auf einige Mängel der zugrundeliegenden Studien auch mit Vorsicht zu genießen. Implikationen für Schule und Unterricht ergeben sich dennoch unmittelbar – insbesondere mit Blick auf das Zusammenspiel von „Sparringspartner“ KI und Menschen im Lernprozess:

1. Positive Effekte auf das Lernen

- Verbesserte akademische Leistungen: Schülerinnen und Schüler, die ChatGPT im Unterricht nutzten, zeigten signifikante Fortschritte in ihren schulischen Leistungen. Besonders in Tests und Aufgaben, die komplexe Problemlösungen erforderten, konnten sie von der Unterstützung durch ChatGPT profitieren.

- Förderung höherer Denkfähigkeiten: Der Einsatz von ChatGPT regte die Schülerinnen und Schüler dazu an, kritisches Denken, Problemlösungsfähigkeiten und Reflexionskompetenzen zu entwickeln. Diese Fähigkeiten sind essenziell für den Erfolg in der modernen Arbeitswelt.

- Gesteigerte Lernmotivation: ChatGPT wurde von den Schülerinnen und Schülern als unterstützend und ansprechend wahrgenommen. Dies führte zu einer höheren emotionalen Beteiligung am Lernprozess und förderte die intrinsische Motivation.

2. Weniger mentale Anstrengung

- Reduzierung der kognitiven Belastung: ChatGPT kann bei komplexen oder umfangreichen Aufgaben unterstützend wirken, indem es schwierige Konzepte erklärt, Zusammenfassungen bietet oder gezielte Hinweise gibt. Dadurch wird die mentale Anstrengung der Schülerinnen und Schüler reduziert, was wiederum zu einem effizienteren Lernen beiträgt.

3. Methodische Herausforderungen in der Forschung

- Unzureichende Stichprobengrößen: Viele der analysierten Studien verwendeten kleine Stichproben, was die Aussagekraft der Ergebnisse einschränkt.

- Fehlende Langzeitanalysen: Die positiven Effekte von ChatGPT wurden vorwiegend in kurzen Zeiträumen untersucht. Ob diese Effekte langfristig anhalten oder nur durch die Neuheit der Technologie bedingt sind, bleibt offen.

- Uneinheitliche Bewertungskriterien: Unterschiede in der methodischen Herangehensweise erschweren die Vergleichbarkeit der Studien.

4. Anwendungsbereiche und Integration von ChatGPT

- Fokus auf universitäre Bildung: Der Großteil der Studien wurde im Hochschulbereich durchgeführt (84 %). Dennoch gibt es erste Ansätze, ChatGPT auch in den Schulunterricht (K-12) einzubinden.

- Einsatz in verschiedenen Fächern: ChatGPT wurde vor allem in Sprachfächern, Naturwissenschaften und Gesundheitswissenschaften eingesetzt. Besonders bei textbasierten Aufgaben oder der Analyse komplexer Inhalte erwies es sich als nützlich.

- Direkte und unterstützende Nutzung: In den meisten Studien nutzten die Schülerinnen und Schüler ChatGPT direkt als Lernwerkzeug. In einigen Fällen wurde es in Lernplattformen integriert, um ein interaktiveres Lernerlebnis zu schaffen.

Was sich wieder einmal deutlich zeigt: Die Frage, ob ChatGPT und ähnliche KI-Tools Potenzial für das Lernen haben, wird in allen bisher erschienen Studien immer ähnlich beantwortet: Ja, das haben sie. Aber es hängt eben sehr davon ab, wie sie eingesetzt und wie sie genutzt werden.

Gerade in Langzeitstudien wird es nun spannend zu sehen, wann und wie diese Technologien Lernprozesse am sinnvollsten fördern oder ganz neue Lernmöglichkeiten schaffen.

Und hier sind auch angesichts solch schneller Studienergebnisse Warnungen angebracht: So verweist Joshua Weidlich (Universität Zürich, Digitale Hochschuldidaktik) in einem LinkedIn-Beitrag auf teils erhebliche Bedenken hinsichtlich ihrer Aussagekraft. Ein zentrales Problem sieht er in der konzeptionellen Ausrichtung der Studie: ChatGPT wird fälschlicherweise als pädagogische Methode betrachtet, obwohl es lediglich ein Werkzeug ist. Welche konkreten Lehrmethoden damit kombiniert wurden, bleibt unklar. Ebenso wird die Vergleichsbedingung nicht ausreichend beschrieben, wodurch die ermittelte Effektgröße (g = 0,7) letztlich wenig aussagekräftig ist. Weidlich spricht hier von einem „Effekt auf der Suche nach einer Ursache“. Zudem stellt er die Qualität der einbezogenen Primärstudien infrage. Ein Beispiel: Eine der Studien vergleicht die Qualität von übersetzten Texten mit und ohne ChatGPT – misst aber nichts, was tatsächlich mit Lernen zu tun hat. Dennoch weist sie eine der höchsten Effektgrößen im gesamten Datensatz auf (g = 3), was die Aussagekraft der Gesamtanalyse weiter infrage stellt. Weidlich kritisiert, dass die Studie ein Symptom für den schnellen wissenschaftlichen Hype um neue Technologien sei.

👉 Hier geht es zur Studie „Does ChatGPT enhance student learning? A systematic review and meta-analysis of experimental studies“

20.10.2024 – „Neue Studie: KI-Agent gewinnt Ideenwettbewerb“ (eine Meldung und ihr Kontext)

Kürzlich machte die Meldung „KI-Agent gewinnt Ideenwettbewerb: Menschliche Experten müssen sich geschlagen geben“ die Runde – denn ein Forschungsteam der Stanford University zeigt in einem preprint-paper, wie sich KI-generierte Forschungsideen gegen menschliche Vorschläge schlagen. Im Fokus stand die maschinelle Sprachverarbeitung (NLP).

Ablauf des Experiments:

49 menschliche KI-Expertinnen und -Experten reichten Forschungsvorschläge ein, die von 79 Gutachterinnen und Gutachtern bewertet wurden. Dabei wussten diese während der Bewertungsrunde nicht, ob die Vorschläge von Menschen oder einer KI stammten.

Ergebnisse:

KI-generierte Vorschläge wurden als „spannender“ bewertet, schnitten jedoch bei der Umsetzbarkeit schlechter ab.

Menschen fokussierten sich auf realistische, bereits bekannte Themen – es zeigte sich also, dass die größere „Kreativität“ der KI hier auf größere „Realisierbarkeit“ der menschlichen Ideen (zumindest aus Sicht der menschlichen Gutachter) traf.

Stärken des LLM/der KI:

Die KI (basierend auf Claude 3.5) konnte mit Daten aus wissenschaftlichen Artikeln eigenständig Hypothesen entwickeln. Von 4000 generierten Ideen wurden jedoch nur 200 als „brauchbar“ eingestuft.

Wie soll es weitergehen:

Das Team wird als nächsten Schritt einen Vergleich von KI-generierten Ideen mit realen Tagungsbeiträgen im Herbst vornehmen und daraus weitere Implikationen ableiten.

Diese Studie zeigt, dass KI spannende Ansätze liefern kann, jedoch oft die praktische Umsetzbarkeit vernachlässigt.

Meine Einschätzung: Aus meiner Sicht bestätigen Studien wie diese exemplarisch – und natürlich begrenzt auf ein enges wissenschaftliches Forschungsfeld – die Grundhaltung, KI als Sparringspartner (nicht mehr, aber auch nicht weniger!) zu sehen.

1️⃣ Im Wechselspiel von Mensch und Maschine kann eine große Chance für mehr Kreativität, bessere Ideen und Unterstützung im Arbeitsprozess liegen (KI als Sparringspartner / Ping-Pong-Metapher).

2️⃣ Gleichzeitig setzen wir Menschen den (realistischen) Rahmen und binden LLM/KI in unsere Denk-, Arbeits- und Lernprozesse mit ein (Mensch als Kontroll- und Steuerungsinstanz).

3️⃣ Die Ergebnisse sind also kein Grund für Euphorie, sondern gerade mit Blick auf (schulische) Lehr-/Lernprozesse ein Indiz dafür, die Implementierung von LLM/KI in die didaktische Planung kritisch zu reflektieren (Lernen mit / durch / über / trotz / ohne LLM/KI) und die jeweiligen Stärken und Schwächen von Mensch und Maschine als Ausgangsbasis für Unterrichtsentwicklung im Rahmen der „4A“ zu sehen.

👉 Hier ein Artikel zur Studie

👉 Hier geht es zur Studie „Can LLMs Generate Novel Research Ideas? A Large-Scale Human Study with 100+ NLP Researchers“

Zwei Studien im Zusammenhang: Was machen, wenn KI menschliche Leistungen übertrifft?

Zwei im Abstand von 1,5 Jahren erschienene Studien lassen – wenn man die Ergebnisse verknüpft – die Arbeitswelt der Zukunft erahnen. Zugleich werfen diese auf Medizin fokussierten Studien die Frage auf, wie wir mit LLM/KI im professionellen Umfeld (und damit genauso im Bildungskontext) umgehen werden:

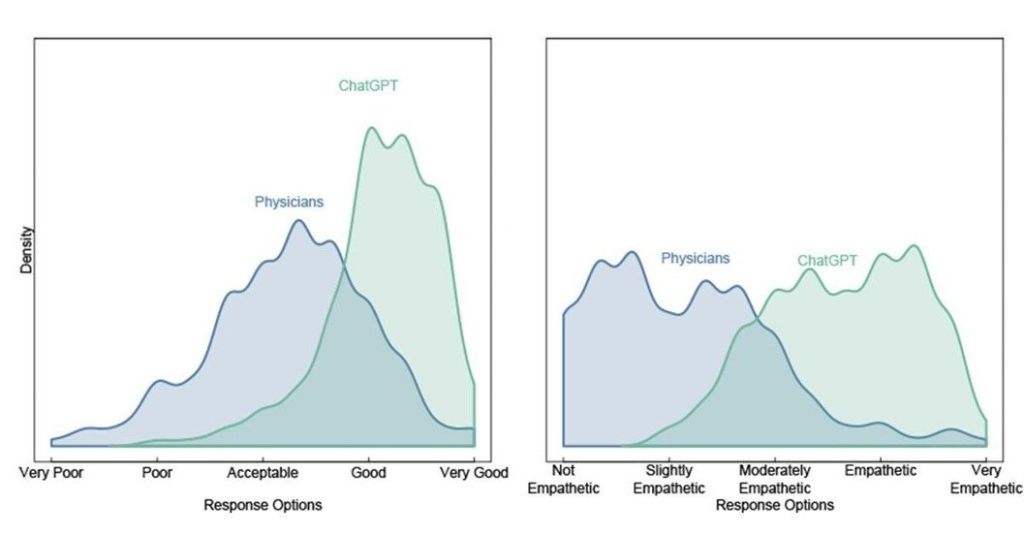

📚 Studie 1 (April 2023) – „Comparing Physician and Artificial Intelligence Chatbot Responses to Patient Questions…“ der University of California untersuchte die Antworten von Ärzten und KI-Chatbots auf Patientenfragen in einem öffentlichen Forum. In der Studie wurden sowohl die Qualität als auch die Empathie von Arzt- und Chatbot-Antworten anhand einer 5-Punkte-Skala bewertet.

➡ Die Chatbot-Antworten schnitten deutlich besser ab: 78,5 % der Chatbot-Antworten wurden als „gut“ oder „sehr gut“ in Bezug auf die Qualität eingestuft, während dies nur für 22,1 % der Arztantworten zutraf. Im Hinblick auf Empathie waren 45,1 % der Chatbot-Antworten „empathisch“ oder „sehr empathisch“, im Vergleich zu nur 4,6 % der Arztantworten. Das wird auch in der unten gezeigten Abbildung eindrucksvoll visualisiert.

📚 Studie 2 (pre-print Oktober 2024) – „Influence of a Large Language Model on Diagnostic Reasoning“ gab in einem Experiment Ärzten Fälle zur Diagnose, wobei die Hälfte Unterstützung durch GPT-4 erhielt.

➡ Die Kontrollgruppe lag in 73 % der Fälle richtig, die GPT-4-Gruppe in 77 % – zunächst kein großer Unterschied. Aber GPT-4 allein erreichte 92 %. Ethan Mollick schließt daraus, dass die Ärzte der KI schlicht nicht zuhören/folgen wollten und damit die Chance, eine verbesserte Diagnose im Zusammenspiel von Mensch und KI zu erstellen, ungenutzt ließen.

Diese Ergebnisse legen nahe, dass KI-Tools das Potenzial haben, bei der Beantwortung von Patientenanfragen zu unterstützen und so nicht nur die Arbeitsbelastung zu verringern, sondern auch die Diagnosequalität zu erhöhen.

Meine Einschätzung: Es erscheint logisch, dass gerade im medizinischen und psychologischen Bereich Schwerpunktforschung in dieser Frage erfolgt. Genauso spannend sind diese Aspekte aber – im übertragenen Sinn – für den Bildungsbereich und die Frage, inwiefern LLM/KI zum Sparringspartner im Lernprozess werden können: Wo sie als Partner unterstützen und neue Möglichkeiten bieten können, wo sie aber auch gezielt ausgeschlossen werden sollen (Lernbegleitung, Tutorielle Systeme etc.). Besonders interessant ist die Verbindung solcher Studien im Sinne eines ersten „Lagebildes“ zum momentanen Stand der (technischen) Dinge, genauso aber zur grundlegenden Haltung gegenüber technischer Innovation.

Studie „Generative AI Can Harm Learning“ (Mathematik / 1.000 SuS)

Die Studie „Generative AI Can Harm Learning“ untersucht die Auswirkungen von generativer KI, insbesondere OpenAI’s GPT-4, auf das Lernen von Schülerinnen und Schülern. Um diese Frage zu beantworten, führte ein Forscherteam ein groß angelegtes Experiment in einer (türkischen) High School durch, das 1.000 Schülerinnen und Schüler aus der 9., 10. und 11. Klasse umfasste. Im Experiment wurde der Einsatz von zwei verschiedenen GPT-basierten Tutor-Systemen untersucht: ein Standard-GPT-4-Interface (genannt GPT Base) und ein spezieller Tutor (GPT Tutor), der darauf ausgelegt ist, das Lernen zu fördern und Schülern keine direkten Antworten zu geben, sondern Schritt-für-Schritt-Hilfen (ähnlich einem sokratischen Tutor) anzubieten.

Aufbau und Methodik der Studie

Das Experiment erstreckte sich über vier 90-minütige Mathematik-Sitzungen, die etwa 15 % des Semesterlehrplans ausmachten. Die Schülerinnen und Schüler wurden zufällig einer von drei Gruppen zugewiesen:

- Kontrollgruppe: Schülerinnen und Schüler hatten nur Zugang zu traditionellen Lernmaterialien wie Lehrbüchern und Notizen.

- GPT Base: Diese Gruppe erhielt Zugang zu einem einfachen ChatGPT-Interface, das ihnen bei der Lösung von Aufgaben half.

- GPT Tutor: Diese Gruppe erhielt Zugang zu einem verbesserten Tutor-System, das speziell darauf ausgelegt war, die Lernenden zu unterstützen, ohne ihnen direkt die Lösungen zu liefern.

Die Sitzungen wurden in zwei Phasen unterteilt: In der ersten Phase bearbeiteten die Schülerinnen und Schüler Aufgaben mit Hilfe der ihnen zugewiesenen Ressourcen (je nach Gruppe), während in der zweiten Phase eine Prüfung ohne Hilfsmittel durchgeführt wurde. Dabei wurde sowohl die Leistung während der Übungsaufgaben als auch in den Prüfungen analysiert.

Schlüsselergebnisse

- Verbesserte Leistung mit KI-Unterstützung: Schüler, die Zugang zun GPT-Tutorsystem hatten, erzielten signifikant bessere Ergebnisse bei den Übungsaufgaben. Schüler im GPT Base-Arm verbesserten sich um 48 % gegenüber der Kontrollgruppe, während Schüler mit dem speziell entwickelten GPT Tutor eine Verbesserung von 127 % erreichten.

- Negative Auswirkungen auf langfristiges Lernen: Nachdem der Zugriff auf GPT-4 nach der Übungsphase entzogen wurde, verschlechterte sich die Leistung der Schüler, die zuvor mit GPT Base gearbeitet hatten. Diese Schüler schnitten in den Prüfungen 17 % schlechter ab als diejenigen, die niemals Zugang zu KI hatten. Dies deutet darauf hin, dass die Schüler die KI als „Krücke“ genutzt hatten, ohne die zugrunde liegenden Fähigkeiten wirklich zu erlernen (hier passt wohl am ehesten der Begriff „skill-skipping“).

- Milderung durch Lern-„Leitplanken“: Der negative Effekt auf die Prüfungsleistung wurde durch den Einsatz von GPT Tutor weitgehend vermieden. Dieses System war darauf ausgelegt, schrittweise Hinweise zu geben, anstatt die Lösungen direkt zu verraten. Dadurch wurden die negativen Auswirkungen auf das Lernen minimiert, und die Schüler im GPT Tutor-Arm schnitten in den Prüfungen nicht schlechter ab als die Kontrollgruppe.

- Gefahr der Überabhängigkeit: Die Studie weist darauf hin, dass Schüler dazu neigen, KI als Ersatz für eigenes Denken zu verwenden, wenn keine geeigneten Sicherungen eingebaut sind. Dies könnte langfristig zu einem Verlust kritischer Fähigkeiten führen, wenn generative KI in Bildungskontexten unkritisch eingesetzt wird.

Fazit

Die Studie liefert wertvolle Erkenntnisse über die Risiken und Chancen des Einsatzes von generativer KI im Bildungsbereich. Während diese Technologien das Potenzial haben, die Leistung in bestimmten Aufgaben kurzfristig zu verbessern, bergen sie auch die Gefahr, das Lernen langfristig zu behindern, wenn sie nicht sorgfältig implementiert werden. Die Autoren betonen, dass geeignete Schutzmaßnahmen, wie in GPT Tutor implementiert, notwendig sind, um sicherzustellen, dass Menschen weiterhin wesentliche Fähigkeiten erlernen und sich nicht zu sehr auf KI verlassen.

Wie Lehrkräfte KI in der Unterrichtsplanung nutzen: Erkenntnisse aus einer Fallstudie (09/2024)

In der Studie „Backwards Planning with Generative AI“ haben Samantha Keppler und ihre Co-Autoren untersucht, wie K12-Lehrkräfte in den USA generative KI wie ChatGPT in ihre Unterrichtsplanung integrieren. Die Studie basiert auf Fallstudien von 24 Lehrkräften aus verschiedenen Fächern und Schulstufen, die 2023/2024 den Einsatz von KI in ihrer täglichen Unterrichtsvorbereitung erprobten. Ziel der Studie war es, herauszufinden, ob und wie diese Technologien die Arbeitsprozesse von Lehrkräften beeinflussen können.

Schlüsselergebnisse:

-

- Drei Nutzungsgruppen von KI: Die Lehrkräfte lassen sich laut der Studie in drei Gruppen unterteilen: (1) diejenigen, die KI für Inputs und Outputs nutzen (z. B. Ideenfindung und Materialerstellung), (2) diejenigen, die nur Outputs (z. B. Quizze und Arbeitsblätter) generieren, und (3) diejenigen, die KI gar nicht verwenden.

- Produktivitätsgewinne: Nur Lehrkräfte, die KI sowohl für Inputs als auch für Outputs einsetzen, berichteten über signifikante Produktivitätssteigerungen. Sie konnten durch KI ihre Arbeitsqualität und Arbeitsbelastung verbessern, während die Gruppe, die nur Outputs generierte, keine nennenswerten Produktivitätsvorteile verzeichnete.

- Veränderung der Arbeitsweise: Lehrkräfte, die KI für Inputs nutzen, berichteten von einer höheren Zufriedenheit mit ihrer Arbeit und einem verbesserten Workflow. Sie nutzten KI, um Unterrichtspläne zu konzipieren und alternative Ansätze für den Unterricht zu finden, was die Qualität ihrer Planung steigerte.

- Herausforderungen und Skepsis: Einige Lehrkräfte zeigten Abneigung gegen die Technologie, insbesondere wegen ethischer Bedenken oder aufgrund der Sorge, dass KI den kreativen und didaktischen Prozess negativ beeinflussen könnte.

Fazit:

Die Studie zeigt, dass der produktive Einsatz von KI in der Unterrichtsplanung entscheidend davon abhängt, wie umfassend Lehrkräfte die Technologie nutzen. Schulen und Bildungseinrichtungen sollten daher Schulungen und Fortbildungen anbieten, die Lehrkräften zeigen, wie sie KI nicht nur für die Materialerstellung, sondern auch für die Planung und Reflexion ihrer Unterrichtsansätze einsetzen können. Dies könnte zu erheblichen Effizienzsteigerungen und einer besseren Anpassung an die Lernbedürfnisse der Schülerführen.

👉 Studie: Backwards Planning with Generative AI: Case Study Evidence from US K12 Teachers

Allgemeine Studien zu KI/LLM in Schule und Unterricht

Vodafone-Studie „Pioniere des Wandels – wie Schüler:innen KI im Unterricht nutzen möchten“ (13.03.2024)

Die Jugendstudie der Vodafone Stiftung zeigt, wie Schülerinnen und Schüler in Deutschland über den Einsatz von KI im Unterricht denken. Kurz: Sie sehen in der Technologie nicht nur ein mächtiges Werkzeug für ihre schulische und berufliche Zukunft, sondern äußern auch klare Erwartungen und Bedenken. Was genau erwarten die Jugendlichen? Und wie sollte sich das Bildungssystem anpassen? Die wichtigsten Ergebnisse im Überblick:

-

- Erwartungen an KI im Schulalltag: 80 % der 14- bis 20-Jährigen erwarten, dass KI den Unterricht in den nächsten 3-5 Jahren deutlich verändern wird. Die Mehrheit sieht KI als Chance, besonders in Großstädten und bei Jugendlichen aus wohlhabenderen Haushalten.

- Relevanz für die Zukunft: 86 % der Befragten glauben, dass KI bald so selbstverständlich wie Smartphones genutzt wird. Über 69 % halten KI-Kenntnisse für entscheidend, um beruflich erfolgreich zu sein.

- Aktuelle Nutzung von KI: KI wird von Jugendlichen hauptsächlich für Recherche, Begriffsdefinitionen und Erklärungen genutzt. Im schulischen Kontext dominiert ChatGPT als am häufigsten verwendetes KI-Tool.

- Differenzierte Sicht auf KI: Jugendliche erkennen die Potenziale, aber auch die Risiken von KI, insbesondere in Bezug auf die Unterscheidung zwischen eigenen Leistungen und KI-generierten Inhalten.

- Veränderte Prüfungsformate: 59 % der Schülerinnen und Schüler fordern neue Prüfungsformate, die Problemlösungsfähigkeiten statt reines Auswendiglernen bewerten.

- Wichtige Kompetenzen im Umgang mit KI: Kritisches Denken, sicherer Umgang mit Daten und die Fähigkeit, KI-Systeme verantwortungsvoll zu nutzen, sind aus Sicht der Jugendlichen entscheidend.

Fazit: Die Studie zeigt, dass Schülerinnen und Schüler nicht nur bereit sind, KI in ihren Lernprozess zu integrieren, sondern auch klare Erwartungen an deren sinnvollen Einsatz im Unterricht haben. Schulen sollten, so ein Fazit der Studie, rasch handeln, um diese Entwicklung zu begleiten. Dabei sollte der Fokus auf der Vermittlung kritischer Denkfähigkeiten und der Anpassung von Prüfungsformaten liegen. Gleichzeitig gilt es, soziale Ungleichheiten zu berücksichtigen, damit alle Schülerinnen und Schüler gleichermaßen von den Potenzialen der neuen Technologie profitieren können.

Wird fortlaufend aktualisiert!

[…] Unterrichten digital bietet “KI & LLM in Schule und Unterricht – relevante Studien im Überblick”: […]