„Ich glaube nicht, dass KI eine Lehrkraft ersetzen wird. Mein Traum ist, dass eine Lehrkraft, die KI nutzt, eine Lehrkraft ersetzt, die das nicht tut.“ John Hattie skizzierte kürzlich in einem seiner Vorträge seinen Blick auf Lernen in Zeiten von KI und schlug auch gleich noch ein neues Konzept vor: „Maßgeschneidertes Lernen“. „Maßgeschneidertes Lernen bedeutet nicht, jedem Kind ein eigenes Curriculum zu geben“, so Hattie. „Es bedeutet, dass Lehrkräfte ihren Unterricht basierend auf dem Lernfortschritt jedes Schülers gezielt anpassen.“

Generative KI, guter Unterricht und das Angebots-Nutzungs-Modell

Nicht zuletzt in diesem Kontext wird der Einzug generativer KI-Systeme im Bildungsbereich vielfach als Chance dafür angesehen, den Unterricht präziser an individuelle Bedürfnisse anzupassen. Doch parallel zu diesen optimistischen Szenarien mehren sich die Hinweise auf ein fundamentales Paradoxon: Während KI-Systeme die kognitive Belastung reduzieren und Aufgaben effizienter erledigen (können), erzeugen sie zugleich einen Effekt kognitiven Offloadings, bei dem essenzielle Denkprozesse zunehmend an die Technologie delegiert werden. Das Phänomen der „metakognitiven Faulheit“ beschreibt dabei die Tendenz, kognitive Verantwortlichkeiten auszulagern und damit aktive Lernprozesse zu umgehen. Das beobachtbare „Skill-Skipping“ und der daraus resultierende Deskilling-Effekt (lesenswert vom Deutschen Ethikrat 2023 problematisiert) werden inzwischen breit diskutiert – nicht zuletzt hier im Blog.

In meinen bisherigen Beiträgen standen zumeist konkrete Einsatzszenarien im Fokus: lernförderliches Feedback mit KI, Tutor-Prompts, Deskilling-Risiken und Fortbildungsmaterialien, die helfen sollen, den KI-Einsatz didaktisch zu strukturieren. Das ist auch der Experimentierphase geschuldet, in der wir uns seit Jahren befinden. Immer neue Sprachmodelle, immer neue Funktionen, immer tiefere Durchdringung zuhause und im Klassenraum, das zeigen alle relevanten Jugend-Studien deutlich.

Zugleich fehlt häufig der „didaktische Überbau“, wenn wir das Thema KI primär methodisch in den Blick nehmen. Im dem Kontext frage ich mich,

-

- ob uns bewährte, aber ältere Modelle aus der Unterrichtsforschung auch unter den Bedingungen von KI noch Orientierung und eine Rahmung für neue Fragen bieten können und

- welche Auswirkungen die Breite und Tiefe der KI-Durchdringung auf allen Ebenen für ein solches Modell mit sich bringen.

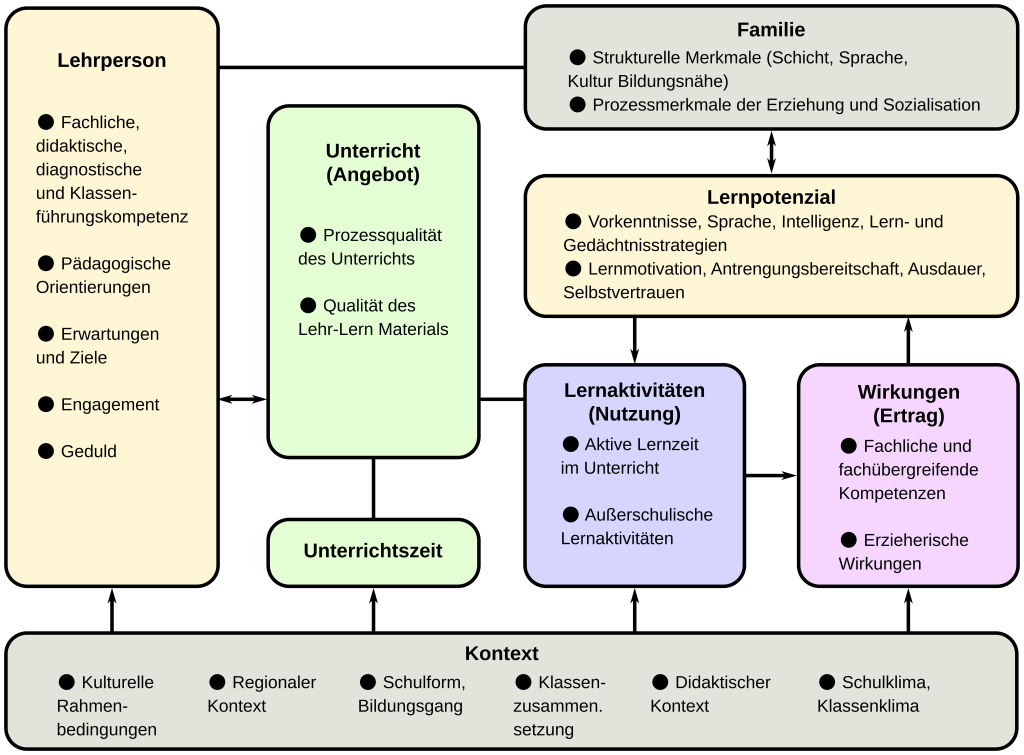

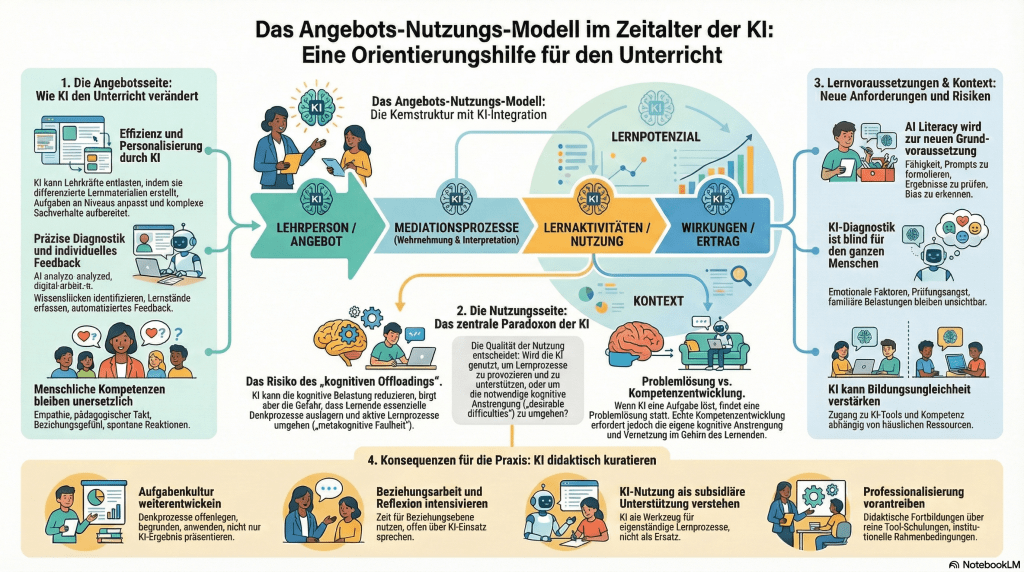

Daher möchte ich in diesem Beitrag die Perspektive drehen und einen Rückgriff in die Zeit meiner eigenen Ausbildung wagen: Mit dem Angebots-Nutzungs-Modell von Andreas Helmke greife ich das wohl prominenteste Wirkmodell der Unterrichtsforschung heraus, das mir als Novize für das Verständnis der komplexen Wirkungsbedingungen von Lehr-Lernprozessen immer wieder hilfreich erschien – und frage, was dieses Modell uns für den Unterricht unter den Bedingungen generativer KI sagen kann. Dabei beziehe ich mich sowohl auf den „Orientierungsband Unterrichtsqualität und Lehrerprofessionalität“ von 2014, in dem Helmke das Modell vorstellt und einordnet, als auch auf die neuere Fassung von 2022.

Als Helmke bei der Vorstellung des Modells schrieb, dass die für den Lernerfolg zentralen Mediationsprozesse „… entscheidend von den individuellen Eingangsbedingungen (insbesondere dem Vorkenntnisniveau, den Lernstrategien und der Lernmotivation) der Schüler“ abhängen, standen sehr wohl bereits digitale Medien, nicht aber (generative) KI als unsichtbarer und allumfassender Riese im Hintergrund.

Lerntheoretische Grundlagen: Warum KI das Lernen nicht ersetzen kann

Dazu vielleicht nur ein ganz kurzer Exkurs, der mir angesichts mancher momentan zu beobachtenden KI-Integration in Plattformen und Tools relevant erscheint: Die drei grundlegenden Lerntheorien – Behaviorismus, Kognitivismus und Konstruktivismus – verdeutlichen, dass Lernen weit mehr ist als die bloße Vermittlung und Aufnahme von Informationen. Fokussiert der Behaviourismus auf beobachtbare Verhaltensänderungen durch Reiz-Reaktions-Verknüpfungen und prägt unser Verständnis von Übung, Wiederholung und Feedback, versteht der Kognitivismus Lernen als aktive Verarbeitung, Strukturierung und Speicherung von Informationen im Arbeits- und Langzeitgedächtnis. Der Konstruktivismus schließlich betont die aktive, subjektive Konstruktion von Wissen, wobei neue Informationen auf Basis individuellen Vorwissens interpretiert und in bestehende Wissensstrukturen integriert werden müssen.

So kommentiert Prof. Sandra Niedermeier ihren Beitrag “Konstruktivismus als Leitidee guter Lehre” für einen aktuellen Sammelband zur Hochschullehre passend mit den Worten: “Inmitten von Debatten über GenAI, EdTech und digitale innovative Lernökosysteme gerät leicht in Vergessenheit, dass Lernen immer noch dort beginnt, wo Menschen Bedeutung konstruieren: durch Erfahrungen, Austausch, Reflexion und das aktive Erarbeiten von Wissen.”

Gerade die konstruktivistische Perspektive – die auch das Angebots-Nutzungs-Modell von Andreas Helmke prägt – macht deutlich, warum generative KI im Bildungsbereich so ambivalent erscheint. Wenn Lernen ein aktiver Konstruktionsprozess ist, bei dem Lernende ihr Verständnis eigenständig aufbauen müssen, kann diese kognitive Arbeit nicht delegiert werden, ohne den Lernprozess selbst zu untergraben. Die Cognitive Load Theory (CLT) ergänzt diese Perspektive: Sie unterscheidet zwischen intrinsischer Last (durch die Komplexität des Lerngegenstands), extrinsischer Last (durch schlechte Instruktionsgestaltung) und „germane load“ (lernbezogene kognitive Belastung). Erfolgreiches Lernen hängt von der angemessenen Balance dieser Belastungsarten ab.

Hier zeigt sich das oben angeführte Paradoxon generativer KI: Einerseits kann die Technologie extrinsische kognitive Last reduzieren, indem Sprachmodelle Informationen strukturiert aufbereiten, Zusammenhänge erklären oder individuell angepasste Übungen bereitstellen. Andererseits besteht die Gefahr, dass diese nicht nur überflüssige, sondern auch notwendige kognitive Anstrengung aus dem Lernprozess verdrängen. Das Konzept der „desirable difficulties“ (Bjork & Bjork 2011) – der wünschenswerten Lernschwierigkeiten – macht deutlich, dass ein gewisses Maß an kognitiver Herausforderung für aktive Lernprozesse und langfristige Retention unverzichtbar ist. Wenn Lernende Aufgaben mit KI lösen, ohne sich selbst gedanklich mit dem Lerngegenstand auseinanderzusetzen, entfällt genau jene produktive Anstrengung, die Lernen ausmacht.

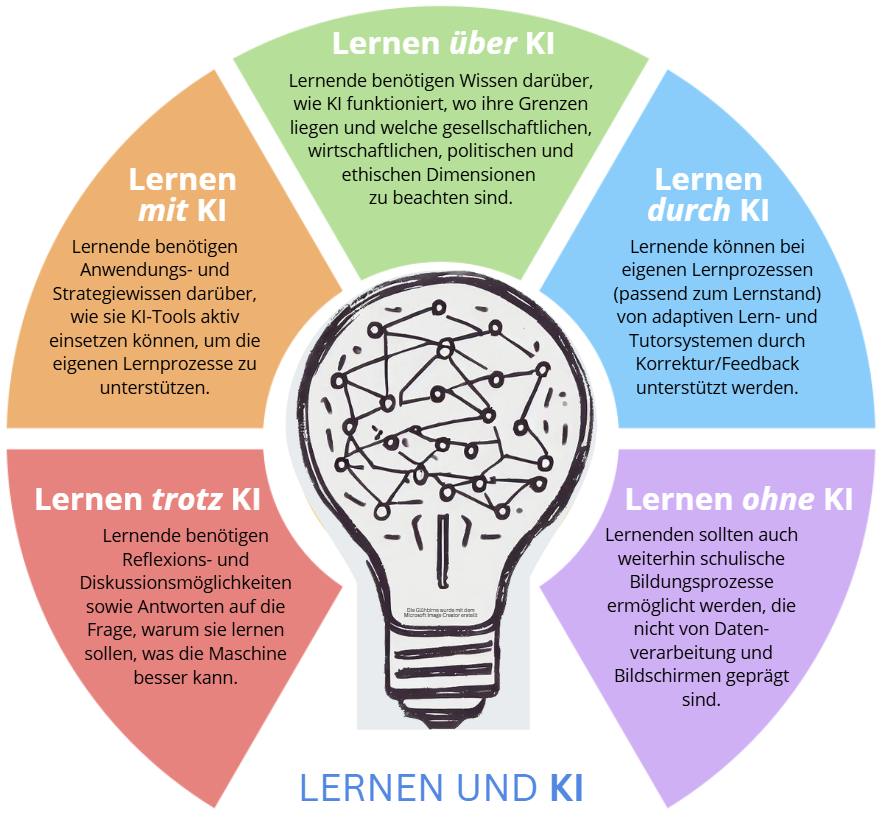

Die Balance zwischen Unterstützung und Herausforderung wird zum zentralen didaktischen Problem. Die Frage “Warum soll ich etwas lernen, das Maschinen besser können?” wird zur Herausforderung für unser Bildungsverständnis.

Das ist insofern besonders spannend, als viele aktuelle Debatten auf der Angebotsseite stehen bleiben: „Endlich personalisiertes Lernen!“, „Endlich automatische Korrektur!“, „Endlich Material auf Knopfdruck!“. Das Angebots-Nutzungs-Modell zwingt uns dazu, weiterzudenken: Wie beeinflusst (generative) KI die Ebenen der „Nutzung“, der „Voraussetzungen“ oder den „Kontext“ – und damit die individuellen Mediationsprozesse?

Das Angebots-Nutzungs-Modell als analytischer Rahmen

Das von Andreas Helmke entwickelte und auf Arbeiten von Helmut Fend und Franz Weinert aufbauende Angebots-Nutzungs-Modell basiert auf einer fundamentalen Einsicht: Unterricht ist ein Angebot, das von Lernenden aktiv genutzt werden muss, damit Lernerfolg entstehen kann. Auch wenn das Modell wichtige Referenzfaktoren außer Acht lässt (ganz entscheidend: welcher Bildungsbegriff und welche Bildungsziele liegen der Frage nach der “Wirksamkeit” von Unterricht eigentlich zugrunde?), das Modell in der Vergangenheit (wie viele Modelle) als unterkomplex kritisiert wurde: Die scheinbar simple Grundkonzeption des Modells hat, wenn man sie zunächst annimmt, weitreichende Konsequenzen für den Blick auf schulische Lernprozesse – gerade unter den Bedingungen generativer KI.

Vier Ebenen des Angebots-Nutzungs-Modells (nach Helmke)

Das Angebots-Nutzungs-Modell unterscheidet systematisch zwischen mehreren Ebenen, die in komplexer Wechselwirkung zueinander stehen. In der heutigen Fassung umfasst das Modell grob vier Bereiche, die durch Mediationsprozesse im Kopf der Lernenden miteinander verknüpft sind:

-

- Unterricht als Angebot: Materialien, Erklärungen, Aufgaben, Lernumgebungen, Interaktionen.

- Nutzung / Lernaktivitäten: Aufmerksamkeit, aktive Lernzeit, kognitive Anstrengung, Strategien.

- Lernvoraussetzungen / Lernpotenzial: Vorwissen, Sprache, Motivation, Selbstkonzept, Lernstrategien.

- Kontext: Familie, Peers, Klassenklima, Schulform, Ressourcen, Bildungssystem.

Die konstruktivistische Grundannahme des Modells ist dabei zentral: Lernende müssen das Unterrichtsangebot wahrnehmen, interpretieren, emotional und motivational darauf reagieren und es durch aktive mentale Auseinandersetzung in ihre bestehenden Wissensstrukturen integrieren. Diese Mediationsprozesse entziehen sich der direkten Steuerung durch Lehrpersonen – und, wie sich zeigen wird, erst recht der technologischen Optimierung durch KI. Das Modell macht damit deutlich, dass es „den“ guten Unterricht nicht geben kann, sondern dass Unterrichtsqualität immer in Abhängigkeit von den spezifischen Voraussetzungen der Lernenden, dem fachlichen Kontext und den Zielsetzungen zu bestimmen ist.

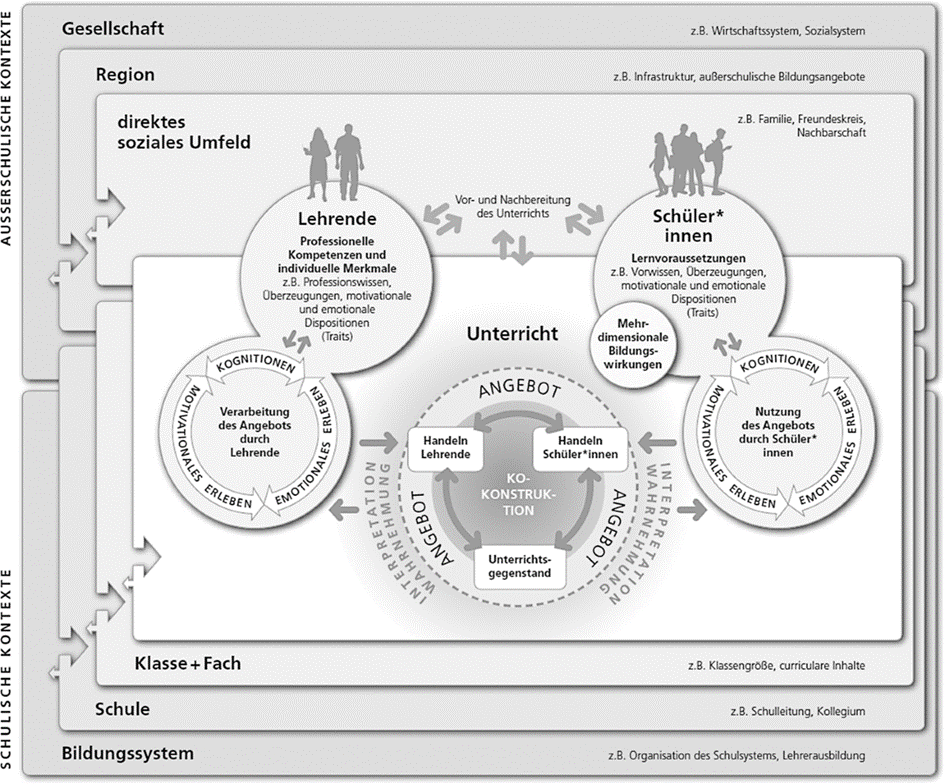

Weiterentwicklung: Integrierendes Schichtenmodell wechselseitiger Beziehungen (nach Vieluf et al. 2020)

Auf Grundlage einer systematischen Auswertung verschiedener Angebots-Nutzungs-Modelle haben Vieluf et al. (2020) ein integrierendes Modell entwickelt. Darin wird Unterricht als gemeinsame Konstruktion (Ko-Konstruktion) des Handelns von Lehrkräften und Lernenden in Bezug auf einen bestimmten Unterrichtsgegenstand beschrieben. Die Beziehung zwischen Angebot und Nutzung wird dabei – und das ist gerade aus Sicht der Schulpraxis besonders wichtig – wechselseitig gedacht, die Visualisierung der unterschiedlichen (Lern-)Kontexte als Schichtenmodell erscheint unmittelbar einleuchtend. Damit erweitern Vieluf et al. das Modell um den Gedanken reziproker Angebots-Nutzungsprozesse; ein Gedanke, den auch Helmke (2022, S. 79) als „nicht nur einleuchtend, sondern sogar unbedingt nötig“ bezeichnet. Nutzung meint in diesem erweiterten Modell das komplexe Zusammenspiel von Kognitionen, Emotionen und Motivation in konkreten Unterrichtssituationen.

KI und die Angebotsseite: Effizienz trifft auf Grenzen

Doch zurück ins Jahr 2025 und ein (ganz praxisbezogener Blick) auf die Erfahrungen der letzten Jahre. Betrachten wir zunächst die Angebotsseite des Modells, zeigt sich das zunächst beeindruckende Potenzial generativer KI besonders deutlich und hier rein exemplarisch:

-

- KI-Systeme können in kürzester Zeit differenzierte Lernmaterialien erstellen,

- Aufgaben an verschiedene Niveaustufen anpassen,

- komplexe Sachverhalte in unterschiedlichen Schwierigkeitsgraden (multimodal) aufbereiten,

- als „Sparringspartner“ oder „Tutorsystem“ alle Beteiligten gleichermaßen unterstützen.

Was früher Stunden der Unterrichtsvorbereitung erforderte, erledigen Tools wie ChatGPT, Claude oder spezialisierte KI-Plattformen (für Unterrichtsvorbereitung / für Präsentationen / für Audios oder Videos etc.) in Sekunden. Die Effizienzgewinne sind enorm und entlasten Lehrpersonen von zeitintensiven Routineaufgaben.

Auch bei der Diagnostik zeigt (generative) KI beeindruckende Fähigkeiten. Moderne Systeme maschinellen Lernens können mit hoher Präzision Wissenslücken identifizieren, Lernstände erfassen und individuelles Feedback generieren. In den hier wieder nur exemplarisch zu verstehenden Blogbeiträgen, so z.B.

-

- in dem Blogbeitrag zu PEER – einem KI-Tutor für Schreibprozesse,

- dem Blogbeitrag zu FelloFish mit ausführlichem Video-Kommentar zu KI-Feedback im Unterricht oder

- dem Blogbeitrag zur aktuell erschienenen Studie „How Does Artificial Intelligence Compare to Human Feedback?„ zur Frage menschlichen und maschinellen Feedbacks

habe ich beschrieben, wie KI- Feedback wichtige Lernprozesse unterstützen kann. Und das DSGVO-konform und für verschiedene Jahrgangsstufen adaptierbar. Die Erfahrung zeigt: Solche Tools ermöglichen schon jetzt eine (mit großer Vorsicht, Vorausschau und damit konkreter Praxiserfahrung zu planende) Form individueller Unterstützung im Lernprozess, die jahrzehntelang ein Traum von Lehrpersonen und Bildungsforschung war.

Doch die Grenzen werden schnell sichtbar und liegen auf der Hand:

-

- Das Sprachmodell kann nicht spüren, wenn eine Klasse in der 6. Stunde müde, verwirrt oder frustriert ist, wenn mein Kurs der 3. Fremdsprache Spanisch in den Stunden davor bereits mit Englisch und Französisch zwei weitere Fremdsprachen hatte (mit allen damit verbundene Auswirkungen).

- Die Maschine kann nicht spontan auf unerwartete Fragen eingehen, nicht mit Humor eine angespannte Situation auflösen und keine authentischen Beziehungen aufbauen. Eine Lehrperson mit Empathie, pädagogischem Taktgefühl und der Fähigkeit, komplexe soziale Situationen zu navigieren, bleibt unersetzlich.

- Mit digitalen Übungsformaten und gerade in Zeiten KI-unterstützter Materialerstellung ist auch eine Renaissance geschlossener Aufgabentypen (Multiple Choice, Lückentexte, Zuordnungsaufgaben) und damit eine Rückkehr zu behavioristischen Lernprinzipien verbunden. Spielerische Übungsformate mit binärem Sofortfeedback können extrinsische Motivation (Punkte sammeln) über intrinsische Motivation (z.B. im Fremdsprachenunterricht: Sprache als Kommunikationsmittel verstehen) stellen und zu fragmentiertem, dekontextualisiertem Lernen führen – Steve Conway spricht auch von zu verhindernder „Zombification“. Zentral ist die didaktisch sinnvolle Einbindung solcher Tools in komplexe Lernaufgaben.

- Wie im Blogbeitrag zu KI-Detektoren beschrieben, führt der Versuch, diese menschliche Dimension durch technische Kontrolle zu ersetzen, nicht nur in die Irre, sondern kann dem Vertrauensverhältnis zwischen Lehrenden und Lernenden fundamental schaden.

- Helmke unterscheidet in seinem Modell auch zwischen verschiedenen Zeitdimensionen des Angebots: von der nominalen Unterrichtszeit über die tatsächliche Unterrichtszeit bis zur nutzbaren Instruktionszeit. KI kann hier zwar unterstützen, etwa durch effizientere Materialerstellung oder durch adaptive Übungsformate, die die aktive Lernzeit erhöhen (ein spannendes Beispiel ist hier die Lernplattform „brian“ aus der Schweiz, die ich seit einigen Monaten teste). Doch die Technologie kann (noch?) nicht die grundlegende Aufgabe übernehmen, einen strukturierten, störungsarmen Unterricht zu gestalten, in dem sich alle Lernenden (sozial) eingebunden und herausgefordert fühlen.

Die Nutzungsseite: Mediationsprozesse und das Paradoxon generativer KI

Auf der Nutzungsseite offenbart sich das zentrale Paradoxon generativer KI im Bildungsbereich. Helmke betont, dass die erfolgreiche Nutzung davon abhängt, ob und wie Lernende das Unterrichtsangebot wahrnehmen, interpretieren und emotional sowie motivational darauf reagieren. KI kann hier auf oberflächlicher Ebene durchaus motivieren – durch individuellere Materialerstellung, differenzierende Elemente, Gamification-Ansätze oder personalisierte Lernpfade. Die Technologie kann aber auch (gerade im Bereich KI-Feedback, bspw. anhand der Plattform FelloFish gut nachzuvollziehen) Fortschritte verfolgen, an Aufgaben erinnern oder adaptives Feedback geben und damit als „Tutor“ oder „Lernbegleitung“ fungieren. Aber die Maschine kann nicht das leisten bzw. ersetzen, was im Zentrum allen Lernens steht: die aktive geistige Auseinandersetzung mit dem Lerngegenstand.

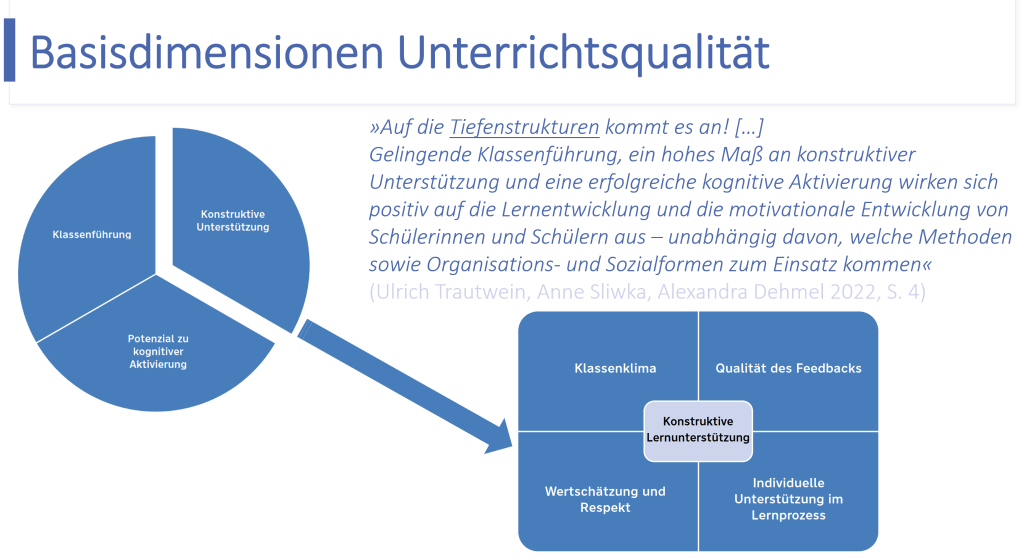

Die Basisdimension der kognitiven Aktivierung, die in der Unterrichtsforschung als zentral für Lernwirksamkeit gilt, verdeutlicht diese Problematik: Lernen ist ein aktiver Prozess, bei dem Lernende ihre Aufmerksamkeit auf das Lernmaterial richten, neue Informationen mit bereits vorhandenem Wissen abgleichen, aktiv Probleme lösen und dadurch ihre Wissensstrukturen erweitern müssen. Wenn Lernende jedoch ChatGPT oder andere KI-Tools nutzen, um Aufgaben schlicht zu lösen, umgehen sie genau jene mentale Anstrengung, die das Lernen ausmacht. Die KI löst das Problem, aber die kognitive Vernetzung bleibt aus. Das ist der fundamentale Unterschied zwischen Problemlösung und Kompetenzentwicklung.

Im Video-Kommentar zu Deskilling habe ich dieses Phänomen ausführlicher und am Beispiel des Geschichtsunterrichts diskutiert: Je nahtloser und hilfreicher die KI-Unterstützung wird, desto größer ist die Versuchung, den schwierigen Weg eigenen Denkens zu vermeiden.

NotebookLM ist ein gutes Beispiel für diese Ambivalenz: Das Tool kann oberflächlich beeindruckende Podcasts, Mindmaps, Erklärvideos und Zusammenfassungen aus hochgeladenen Materialien generieren. Doch die entscheidende Frage bleibt: Haben die Lernenden sich wirklich mit den Inhalten auseinandergesetzt, oder haben sie nur KI-generierte Produkte konsumiert? Werden KI-generierte Materialien als Ausgangspunkt quellenkritischen Lernens gesehen oder trotz aller technologischen Mängel und Schwierigkeiten als faktisch richtiges „Lernposter“ akzeptiert?

Die Qualität der Mediationsprozesse entscheidet darüber, ob echtes Lernen stattfindet – und diese lassen sich nicht durch noch so ausgefeilte KI-Tools garantieren. So konstatierte auch eine Schülerin aus meinem Geschichte-Leistungskurs etwas konsterniert, nachdem der Kurs eigene Podcasts konzipiert und aufgenommen und anschließend mit der Podcast-Erstellung per NotebookLM verglichen hatte: „…dass die ganze aktive Vorarbeit da ja gar nicht vorhanden ist – und das ist ein bisschen schade.“

Individuelle Voraussetzungen: Diagnostik versus ganzheitliches Verstehen

Bei der Erfassung individueller Lernvoraussetzungen zeigt KI sowohl analytische Stärken als auch fundamentale Schwächen. Moderne KI-Systeme können mit beeindruckender Präzision ermitteln, welches Vorwissen vorhanden ist, wo Wissenslücken bestehen und welche kognitiven Fähigkeiten entwickelt sind. Diese datenbasierte Diagnostik übertrifft oft die intuitive Einschätzung erfahrener Lehrpersonen – zumindest bei messbaren Kompetenzen (interessanter Beitrag zu KI als Beurteilungshilfe von Dr. Thorben Jansen im FelloFish-Blog).

Andererseits bleiben genau jene Aspekte, die empirische Forschung als besonders lernrelevant identifiziert, für KI weitgehend unsichtbar: Prüfungsangst, familiäre Belastungen, fragile Selbstkonzepte, Erfahrungswissen, das sich nicht in Textform zeigt – ein zentraler Bereich auch meiner Arbeit als Oberstufenkoordinator. So betonen neuere Reviews zu KI in der Schule, dass emotional-motivationale Voraussetzungen ohne die diagnostische Sensibilität der Lehrkraft kaum angemessen berücksichtigt werden können.

Hinzu kommt eine zusätzliche Schicht: KI-Kompetenz (AI Literacy) selbst wird zur Lernvoraussetzung. Wer weiß, wie man gute Prompts formuliert, Antworten prüft, Bias erkennt und „Halluzinationen“ (Prof. Katharina Zweig schlägt sinnvollerweise den Begriff „Konfabulation“ vor) identifiziert, kann aus KI-Tools echten Lerngewinn ziehen. Wer das nicht kann, wird zum Spielball der Systeme. Der EU AI Act verstärkt diese Perspektive, indem das Rechtsdokument ausdrücklich fordert, dass User über ein Mindestmaß an KI-Kompetenz verfügen müssen – ein Punkt, den ich in meinem Beitrag zum AI Act ausführlich diskutiert habe.

Zudem hebt Helmke in seinem Modell hervor, wie stark das Elternhaus das Lernen beeinflusst – durch die soziale Schicht, das häusliche Lernumfeld und die Erwartungen der Eltern. Diese komplexen soziokulturellen Faktoren kann KI bestenfalls indirekt erschließen, aber nicht angemessen berücksichtigen. Wie im Blogbeitrag zu Schülerberichten deutlich wird, nutzen viele Jugendliche KI pragmatisch als „digitale Spickhilfe“ in einem Input-Output-orientierten Schulsystem. Diese Nutzungsmuster zu verstehen, erfordert sowohl ein Verständnis ihrer Lebenswelt, ihrer Motivationen und ihrer Ängste als auch der (diese Verhaltensweisen verstärkenden) Schwächen unseres Bildungssystems – Dimensionen, die sich jeder algorithmischen Erfassung entziehen.

Der Kontext: Analoge und digitale Welt

Die Kontextfaktoren – Familie, Freundeskreis, Schulkultur und gesellschaftliche Rahmenbedingungen – sind der Bereich, in dem KI zunächst vielleicht weniger wirkt (oder?). Der Einfluss der Peer-Group, die familiären Unterstützungsmöglichkeiten und die Schulkultur bleiben eine menschliche Domäne. Hier zeigt sich eine fundamentale Grenze technologischer Lösungen: Sie können individuelle Defizite kompensieren, aber keine strukturellen Ungleichheiten beseitigen. Im Gegenteil: Gut gemeinte KI-Lösungen können bestehende Bildungsungleichheiten sogar verstärken, wenn sie voraussetzen, dass alle Lernenden über die gleichen technischen Ressourcen, digitalen Kompetenzen oder die häusliche Unterstützung verfügen, um diese Tools lernförderlich zu nutzen.

Nur ein aktuelles Beispiel: Wie sehr der Umgang mit (generativer) KI von geographischen und damit vermutlich sozioökonomischen Faktoren abhängen kann, zeigt die kürzlich erschienene Studie „Teaching the AI-Native Generation“ (Oxford University Press, Oktober 2025). Hier zeigen sich in allen Bereichen (KI-Nutzung, KI-Kompetenz, aber auch Selbstvertrauen ggü. KI-Inhalten) signifikante Unterschiede zwischen Jugendlichen aus dem Raum London und der britischen Peripherie – ein Anhaltspunkt für den erheblichen „digital divide“, der besonders die Kontextfaktoren von Lernerfolg betrifft?

Hybride Settings im Kontext der Tiefenstrukturen von Unterricht

(Generative) KI kann also das Angebot je nach Sichtweise erweitern (inflationär aufblasen?) oder optimieren (behaviouristisch durchdringen?), hat aber weniger Einfluss auf die Verarbeitungsprozesse seitens der Lernenden. KI kann (individuellere) Materialien bereitstellen, aber nicht gewährleisten, dass diese subjektiv bedeutsam werden. Die Maschine kann Feedback geben, aber nicht garantieren, dass es zu Reflexion und tieferem Verständnis führt.

Hybride Settings, die auf einem Wechselspiel aus Mensch und Maschine beruhen, scheinen ein vielversprechender Ansatz zu sein – das zeigen auch die Erfahrungen mit und Studien zu KI-Feedback. So betont die aktuelle Unterrichtsforschung dann auch mit der Trias von Klassenführung, konstruktiver Unterstützung und kognitiver Aktivierung genau jene Dimensionen, die sich nur schwer technologisch abbilden lassen. Sehr lesenswert dazu sind die “Grundlagen für einen wirksamen Unterricht” von Trautwein, Sliwka und Dehmel, die es sehr lohnt unter den Bedingungen von KI zu betrachten. Die folgende Darstellung nutze ich zur grundlegenden Problematisierung des KI-Hypes bei gleichzeitiger Fokussierung auf Potentiale von (generativer) KI. Das Ziel ist, unter dem Motto “Zwei Schritte vor, einen zurück!” zur Diskussion anzuregen.

Denn auch hier tritt (generative) KI immer stärker auf den Plan, wenn zunehmend hybride Settings (z.B. mit Blick auf konstruktive Lernbegleitung und Feedback) den Lernalltag bestimmen. So ehrlich sollten wir sein: Der Bereich individueller Unterstützung, und hier insbesondere Feedback und konstruktive Lernbegleitung, lässt sich schon jetzt in einen maschinellen und einen menschlichen Teil trennen.

Konsequenzen für die Schulpraxis

Was bedeuten diese Erkenntnisse für die konkrete Unterrichtspraxis? Zunächst einmal eine realistische Einschätzung: KI wird bestimmte Aspekte des Lehrens und Lernens verbessern, andere aber unberührt lassen oder sogar gefährden.

Im Bereich des Angebots können wir mit relevanten Verbesserungen rechnen: effizientere Materialerstellung, präzisere Diagnostik und personalisierte Lernpfade. Diese Entwicklungen werden Lehrpersonen (hoffentlich) von vielen Routinetätigkeiten befreien und mehr Zeit für genuin pädagogische Aufgaben schaffen. Und das schließt an den von John Hattie formulierten Wunsch nach „maßgeschneidertem Lernen“ und danach, „dass Lehrkräfte ihren Unterricht basierend auf dem Lernfortschritt jedes Schülers gezielt anpassen“, unmittelbar an.

Die eigentliche Professionalisierungsaufgabe liegt dann nicht im Schreiben immer besserer Prompts, sondern im didaktischen Kuratieren der KI-Outputs. Das schließt – wie ich im Beitrag zum AI Act betont habe – rechtliche und ethische Aspekte mit ein und wird für Schulen zur doppelten Aufgabe:

-

-

- KI-gestützte Diagnostik nutzen, um Lernstände präziser zu erfassen – ohne dabei Person und Kontext aus dem Blick zu verlieren.

- AI Literacy selbst als Bildungsziel begreifen und curricular zu verankern – etwas, das viele Lehrpersonen bereits im Kontext der „5 Dimensionen“ vorgeschlagen haben.

-

Bei der Nutzung bleiben jedoch die fundamentalen Herausforderungen bestehen. KI kann die Mediationsprozesse im Kopf der Lernenden nicht ersetzen, kann keine emotionale Beteiligung schaffen, die nachhaltiges Lernen ermöglicht. Und Sprachmodelle können vor allem nicht die aktive kognitive Auseinandersetzung übernehmen, ohne die kein echtes Lernen stattfindet.

Für die Nutzungsebene im Modell heißt das, wir müssen Lernprozesse bewusst so gestalten, dass KI-Einsatz Lernaktivität provoziert, statt sie zu ersetzen. Das ist der Punkt, an dem sich die Überlegungen aus dem Poster „Lernen und KI – fünf Dimensionen“ treffend mit dem Angebots-Nutzungs-Modell verschränken: Die 5 Dimensionen unterscheiden u.a. das Lernen mit, über und trotz KI – und genau diese Differenzierung lässt sich hervorragend auf die Nutzungsebene in Zeiten von KI beziehen.

Daraus ergeben sich konkrete Handlungsfelder:

Transparenz und Reflexion systematisch einbauen

Wir müssen offen mit Lernenden über KI sprechen – nicht erst, wenn es um Betrugsfälle geht, sondern kontinuierlich im Unterricht. Nur wenn Lernende ihre eigenen Erfahrungen, Strategien und Unsicherheiten thematisieren können, entsteht ein realistisches Bild. Die Unterscheidung zwischen sinnvoller KI-Nutzung als Lernbegleitung und problematischer Nutzung als Abkürzung muss immer wieder Gegenstand der Reflexion sein, stellt aber (endlich!) auch neue Anforderungen an die Angebotsebene und damit an uns Lehrpersonen.

Aufgaben- und Prüfungskultur weiterentwickeln

Wenn KI bestimmte Aufgabenformate trivial macht, müssen wir neue entwickeln. Das bedeutet nicht, dass wir nur noch kreative Projekte durchführen können. Aber wir müssen Aufgaben so gestalten, dass die kognitive Aktivierung im Zentrum steht, dass Lernende ihre Denkprozesse offenlegen und begründen müssen, dass Transfer und Anwendung gefordert sind. Hier stehen Aufgaben- und Prüfungskultur in einem engen Wechselspiel zueinander. Wichtig ist, dass die KMK bereits frühzeitig reagiert und in ihren Handlungsempfehlungen zum Umgang mit KI in schulischen Bildungsprozessen im Sommer 2024 sehr deutlich Entwicklungsbedarfe identifiziert und entsprechende Vorgaben skizziert hat. Auch ist erfreulich zu sehen, dass sowohl in neuen Oberstufenverordnungen als auch mit Blick auf die Sekundarstufe I zunehmend komplexere Prüfungsformate (in Niedersachsen beispielsweise der „Kombinierte Leistungsnachweis“ mit produktiven und reflexiven Elementen) Einzug in den Schulalltag halten.

Differenzierung zwischen Angebot und Nutzung schärfen

Wir müssen uns bewusst machen, dass ein noch so perfektes KI-generiertes Lernangebot wertlos ist, wenn die Nutzung nicht in Passung dazu steht. Das bedeutet, dass wir gerade bei KI-Nutzung noch stärker die Mediationsprozesse in den Blick nehmen müssen:

-

- Wie verarbeiten Lernende im schulischen Umfeld angebotene Informationen?

- Welche kognitiven Aktivitäten finden statt?

- Wo liegt echte Auseinandersetzung vor, wo nur Konsum?

Und das bedeutet dann auch, sehr genau zwei Aspekte bei der Planung und Reflexion von Lernprozessen (im besten Fall gemeinsam mit Schülerinnen und Schülern) zu berücksichtigen – nämlich a) die subsidiäre Nutzung von KI zur Unterstützung und Verbesserung des Lernens bei b) gleichzeitiger Betonung des eigenständigen Lernens.

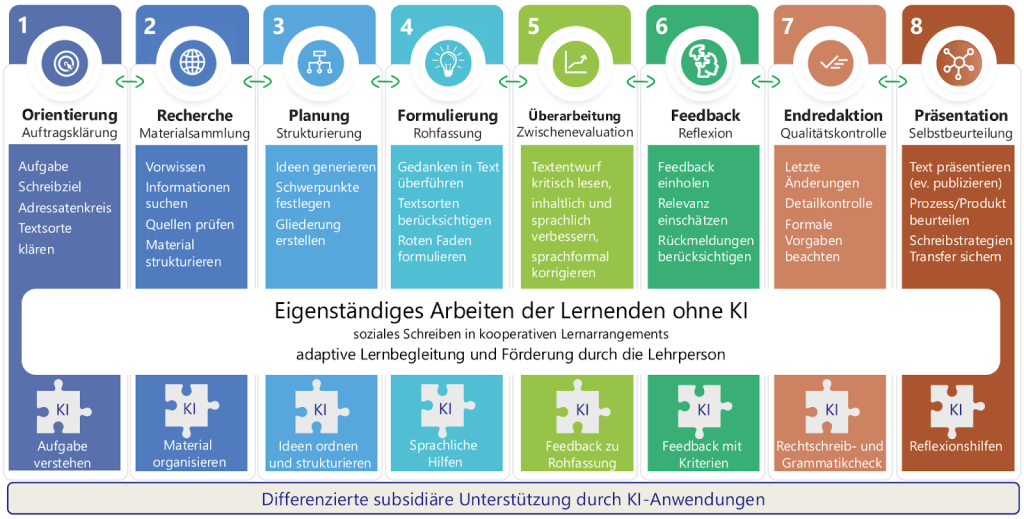

Was bedeutet das konkret? Das haben Gerold Brägger, Joscha Falck und ich am Beispiel des Schreibprozesses für die PÄDAGOGIK 05/2025 ganz praktisch versucht zu skizzieren:

Brägger, Falck, Pölert: Eigenständig schreiben mit KI, in: PÄDAGOGIK 09/2025 “Schreibkompetenz fördern”

Beziehungsarbeit intensivieren

Gerade weil KI bei der Diagnostik und Rückmeldung unterstützen kann, wird die menschliche Beziehungsebene noch wichtiger. Lernende brauchen Lehrpersonen, die sie in ihrer Gesamtpersönlichkeit wahrnehmen, die emotionale Unterstützung geben und die eine Lernkultur schaffen, in der Anstrengung und Wertschätzung konstruktiv verbunden werden. Es mag simpel klingen, aber im Rahmen einer Fragerunde bei einem KI-Elternabend skizzierte ich das Bild einer Renaissance von Natur- und Gruppenerfahrung (Erlebnispädagogik). Ebenso warf ich die Frage nach einer Renaissance lebensreformerischer Ideen der 1920er Jahre auf, die sich dann in teilweise bis heute existenten Reformschulen äußerten, und denen auch schon vor 100 Jahren ein Unbehagen angesichts einer zunehmend als technisiert und gleichförmig empfundenen Welt zugrunde lag, in der das Individuum aus dem Blick gerät.

Micha Pallesche, Rektor der beim Deutschen Schulpreis mit dem Demokratiepreis ausgezeichneten Ernst-Reuter-Gemeinschaftsschule, beschreibt die Zielsetzung in einem LinkedIn-Beitrag am 07.12.2025 so: Zwischen dem, was wir erklären, und dem, was tatsächlich ankommt, liegt ein Raum, der nicht selbstverständlich überbrückbar ist. Genau hier entsteht eine professionelle Haltung. Diese wird durch lernbegleitende Diagnostik, formative Rückmeldungen, dialogische Lernformen, echte Partizipation sowie regelmäßiges Feedback und die Reflexion des eigenen Lernprozesses durch Schülerinnen und Schüler erreicht, wie es beispielsweise beim individuellen Coaching der Fall ist. Kurz: Durch Lernprozesse, die Lernende aktiv einbeziehen und das individuelle Verstehen Schritt für Schritt sichtbar werden lassen.

Professionalisierung vorantreiben

Lehrpersonen brauchen selbst Sicherheit im Umgang mit KI. Nur wer eigene Erfahrungen gesammelt hat, kann Lernprozesse sinnvoll steuern. Die Fortbildungslandschaft muss über reine Tool-Schulungen hinausgehen und didaktische Fragen systematisch adressieren. Spätestens jetzt heisst das auch: Vergessen wir die 16 Bundesländer mit ihrem föderalen Dschungel. Es ist Zeit für leicht skalierbare Fortbildungsangebote für alle, die sich an einem gemeinsamen Referenz- und Kompetenzrahmen orientieren. Und das bedeutet auch, erforderliche Kompetenzen transparent zu machen und systematisch (theoretisch und praktisch) zu schulen.

In meinen Augen bildet die Entwicklung vom TPACK- zum DPACK-Modell eine entscheidende Grundlage dafür, denn das DPACK-Modell lässt sich hinsichtlich der Anforderungen an Lehrpersonen in einer von Digitalität geprägten Lernumgebung präzise mit dem Angebots-Nutzungs-Modell verschränken: Als wichtige Grundlage auf der Angebotsebene von Unterricht, ohne die Lehrpersonen Gefahr laufen, an pädagogischen und technischen Realitäten vorbei zu planen. Zugleich eignet sich die Verschränkung der beiden Modelle auch, um der offensichtlichen Überforderung, die viele Lehrpersonen angesichts steigender und zunehmend komplexerer Berufsanforderungen verspüren, im Kontext von Digitalität und KI einen konkreten Rahmen zu verleihen. Hier müssen Ausbildung und Fortbildung ansetzen – das gilt also für alle Phasen gleichermaßen.

Kontext Bildungssystem

In mehreren Beiträgen habe ich versucht zu zeigen, dass KI-Einsatz in Schule ohne eine institutionelle Rahmung kaum verantwortungsvoll zu gestalten ist. Klare Vorgaben zur Datenverarbeitung, Kriterien für Werkzeuge, Fortbildungsangebote, Schulkonzepte, die KI nicht nur technisch, sondern pädagogisch verorten. Im Sinne des ANM sind das keine „Nebenschauplätze“, sondern konstitutive Rahmenbedingungen des Angebots. Sie entscheiden mit darüber, ob (generative) KI in Form von Lernplattformen und Chatbots überhaupt verfügbar ist, unter welchen Bedingungen sie genutzt werden darf und welche Erwartungen an Lehrkräfte gestellt werden.

Gleichzeitig bleibt eine ernüchternde Einsicht gültig: Strukturelle Ungleichheiten lassen sich durch technologische Lösungen nicht einfach wegmoderieren – im Gegenteil können sie verstärkt werden, wenn KI-Angebote ungleich verteilt sind. Das ist eine Aufgabe für die Bildungssteuerung, deren momentane Lösungsansätze allerdings ebenfalls eher ernüchternd ausfallen.

Fazit: Das Helmke-Modell als Orientierung (auch) im KI-Zeitalter

Das Angebots-Nutzungs-Modell bietet uns nach wie vor eine Struktur, die gerade wegen der tiefgreifenden Überforderung auf allen Seiten für den Umgang mit generativer KI in Lehr-Lern-Prozessen einen wertvollen Orientierungsrahmen darstellt. Trotz klarer Limitierungen, die sowohl in den lesenswerten „Überlegungen zu Chancen und Grenzen des derzeit prominentesten Wirkmodells der Schul- und Unterrichtsforschung“ von Kohler und Wacker als auch von Andreas Helmke im Gespräch mit Hilbert Meyer (Stichwort: Lernen als reziproker Prozess / gegenseitige Angebote / Mehrdimensionalität des Lernprozesses vs. lehrerzentrierte Perspektive) umfassend diskutiert werden, liefert das Modell einen kompakten Überblick über die wichtigsten Variablenbündel zur Erklärung (der Einflussgrößen) von Lernerfolg und deren komplexes Zusammenwirken. Zugleich benennt es mit

-

- der Qualifikation der Lehrpersonen (z.B. für die Diagnose von Lernständen, für das individuelle Fördern, für die Herstellung eines lernfreundlichen Klimas, …),

- der Qualität der Lehr-Lernprozesse,

- der Qualität der eingesetzten Arbeitsmittel und Medien

- und der zur Verfügung gestellten Lernzeit

wichtige steuerbare Bedingungen im professionellen Kontext, verweist aber ebenso auf nicht steuerbare Rahmenbedingungen.

Die Durchdringung aller Ebenen mit (generativer) KI verstärkt daher eher die hilfreiche Funktion des Angebots-Nutzungs-Modells, wenn wir die momentan dominierende Tool-Methoden-Ebene zugunsten eines systematischeren Ansatzes in den Hintergrund treten lassen wollen („Zwei Schritte vor – einen zurück!“) – und limitierende Faktoren des Modells bedenken.

So macht das Modell auch deutlich, dass es nicht darum geht, ob KI „gut“ oder „schlecht“ für die Bildung ist. Es geht darum, differenziert zu verstehen, in welchen Bereichen des komplexen Lehr-Lern-Prozesses KI unterstützen kann und wo menschliche Kompetenz unverzichtbar bleibt. Die größte Gefahr besteht darin, zu glauben, KI könne die schwierigsten Aspekte des Lernens – Motivation, Aufmerksamkeit, kognitive Aktivierung – automatisieren. Diese Aspekte bleiben die zentralen pädagogischen Herausforderungen, für die menschliche Expertise erforderlich ist, während KI uns zugleich der eingangs formulierten Hoffnung Hatties, „… dass Lehrkräfte ihren Unterricht basierend auf dem Lernfortschritt jedes Schülers gezielt anpassen“ etwas näher bringen kann.

Und mit Blick auf notwendige Anpassungen des Angebots-Nutzungs-Modells an z.B. offenere Lernformen, die gerade angesichts der Herausforderungen von KI zunehmend den Bildungsdiskurs prägen, konstatieren auch Kohler und Wacker: „Das Modell beinhaltet jedoch über den Angebotsbegriff mögliche Anschlussstellen zur Weiterentwicklung, in welcher die Angebotsseite mit Blick auf die Schülerinnen und Schüler geöffnet werden kann, um adäquater auch offene Unterrichtsformen abbilden zu können.“ Hier wird es sicherlich spannend zu beobachten, wie Pädagogik und Didaktik in der nächsten Zeit diese Entwicklung begleiten und ob neue Weiterentwicklungen, die KI explizit mit einbeziehen, entstehen werden.

Dass KI unser Bildungssystem verändern wird, ist so unausweichlich wie (allein schon mit Blick auf die Reaktionen der KMK) offensichtlich. Wie viele andere Lehrpersonen freue ich mich darüber, dass uns die Technologie auch zwingt, uns auf das zu konzentrieren, was menschliches Lernen ausmacht. Und das ist vielleicht die wertvollste Funktion: Generative KI erinnert uns daran, dass Bildung mehr ist als Informationsverarbeitung und die wichtigsten Lernprozesse nach wie vor in den Köpfen (und Herzen) stattfinden – durch aktive kognitive Auseinandersetzung, durch Anstrengung und Durchhaltevermögen, durch die Begleitung empathischer Lehrpersonen und durch die Einbettung in soziale Kontexte, die Lernen erst ermöglichen.

Und das berührt die Dimension, die vom Angebots-Nutzungs-Modell nicht erfasst wird: Unser Verständnis, unser Begriff von guter Bildung, in den letztlich jeder Lehr-Lernprozess eingebettet ist. „Das Modell lässt einen Sinnbegriff vermissen“, schreiben Kohler und Wacker sehr passend, und weisen darauf hin, dass „dieser relevante Punkt nicht hinreichend im Modell mit seinem impliziten Wirkbegriff abgebildet werden [kann]. Solange diese Begrenzung des Modells gesehen und ihm nicht mehr zugetraut wird, als es zu leisten vermag, resultiert daraus noch kein Problem.„

Die Diskussion um die Sinnfrage werden wir aber gerade angesichts einer Technologie, die uns zunehmend den Spiegel vorhält und Mängel unseres Bildungssystems gnadenlos offenlegt, führen müssen.

Das aber übersteigt den Rahmen eines Blogbeitrags, der eigentlich nur als eine Art reflektierend-entwickelndes Lerntagebuch gedacht war.

Verwendete Quellen

- Hattie, John (2025): „Maßgeschneidertes Lernen“, in: https://www.news4teachers.de/2025/10/john-hattie-rechnet-mit-dem-individualisierungs-hype-beim-unterricht-ab-das-groesste-problem-liegt-in-der-ueberbetonung-des-alleinarbeitens/ [Letztes Abrufdatum: 19.11.2025].

- Helmke, Andreas (2014/2022): Unterrichtsqualität und Lehrerprofessionalität. Diagnose, Evaluation und Verbesserung des Unterrichts.

- Kohler, Britta; Wacker, Albrecht (2013): Das Angebots-Nutzungs-Modell. Überlegungen zu Chancen und Grenzen des derzeit prominentesten Wirkmodells der Schul- und Unterrichtsforschung, Die Deutsche Schule 105, S. 241-257, in: https://www.pedocs.de/volltexte/2022/25755/pdf/DDS_2013_3_Kohler_Wacker_Das_Angebots_Nutzungs_Modell.pdf [Abrufdatum: 20.11.2025].

- Sprachmodelle: Claude Sonnet 4.5 für die Zusammenfassung von Lerntheorien im einleitenden Absatz „Lerntheoretische Grundlagen“; ChatGPT 5.1 für die inhaltliche Kürzung und sprachliche Präzisierungsvorschläge im Absatz „Das Angebots-Nutzungs-Modell als analytischer Rahmen“.

- Trautwein, Ulrich; Sliwka, Anne; Dehmel, Alexandra (2022): Grundlagen für einen wirksamen Unterricht, in: https://ibbw-bw.de/site/pbs-bw-rebrush2024/get/documents_E552984303/KULTUS.Dachmandant/KULTUS/Dienststellen/ibbw/Empirische%20Bildungsforschung/Programme-und-Projekte/Wirksamer_Unterricht/IBBW_WU1_Trautwein_et_al%20%282022%29_GrundlagenWirksamerUnterricht.pdf [Abrufdatum: 01.11.2025].

- Vieluf, S., Praetorius, A.-K., Rakoczy, K., Kleinknecht, M., & Pietsch, M. (2020): Angebots-Nutzungs-Modelle der Wirkweise des Unterrichts – Ein kritischer Vergleich verschiedener Modellvarianten. Zeitschrift für Pädagogik, Beiheft, 66, 63–80.

- ZSL Baden-Württemberg (2025): KI als Standortfaktor – wichtiger Austausch zwischen Wirtschaft, Wissenschaft und Bildung, in: https://zsl-bw.de/,Lde/startseite/ueber-das-zsl/aktuelles-hattie-vortrag-2025-09-18 [Abrufdatum: 21.11.2025].

- Einen interessanten Beitrag, den ich im Rahmen meiner Recherchen zu diesem Thema fand, hat auch Prof. Barbara Geyer geschrieben: Sie nimmt in ihrem lesenswerten Text „KI und Lernen. Was Maschinen können und was Menschen brauchen“ ebenfalls das Angebots-Nutzungs-Modell in den Blick.

Ein sehr gelungener Beitrag, der die aktuelle KI-Debatte überzeugend in einem sinnvollen didaktischen Rahmen verknüpft. Gelungen erscheint mir, dass das Angebots-Nutzungs-Modell hier nicht relativiert, sondern als Orientierungsfolie genutzt wird, um KI jenseits von Technikoptimismus oder Alarmismus einzuordnen. Die Betonung der aktiven Nutzung durch Lernende macht deutlich, dass auch KI-gestützte Lernumgebungen schlichtweg und einfach pädagogisch gestaltet und begleitet werden müssen. Ein wichtiger Impuls für eine differenzierte, professionell reflektierte Diskussion über Lernen mit KI.