Ich vermute, viele von uns werden das so oder ähnlich im Verlauf ihrer Schullaufbahn auch ganz ohne KI erlebt haben: Nicht gelernt, lieber abgeschrieben (dummerweise bei dem Falschen). Nicht selber nachgedacht, lieber schnell kopiert (nur leider nicht richtig). Es klang doch beim Nachbarn alles so gut und logisch…

Wir reden viel von den mit KI verbundenen Chancen für menschliches Lernen, weniger von den Gefahren. Dabei beginnt sich immer klarer abzuzeichnen, was es bedeutet, wenn der „Sparringspartner“ im Lernprozess aufs Glatteis führt. In einer kleinen Blogserie möchte ich diese Herausforderungen – teils mit didaktischem Fokus, teils als Kommentar – weiter verfolgen.

KI als false buddy: Wenn Sprachmodelle überzeugend klingen – und inhaltlich aufs Glatteis führen

Die Nutzung generativer KI, insbesondere von Large Language Models (LLM) wie ChatGPT, Claude Sonnet oder DeepSeek, ist zur Selbstverständlichkeit auch in Lernkontexten geworden. Sprachmodelle formulieren fehlerfreie Texte, reagieren prompt auf Aufgabenstellungen und liefern scheinbar fundierte Antworten auf komplexe Fragen. Für viele Lernende wirkt KI wie ein wohlwollender Lernbegleiter – schnell, eloquent, stets verfügbar. Und natürlich sind die Ergebnisse oft erstaunlich gut. Nicht ohne Grund nutze ich schon länger die Analogie der KI als Sparringspartner. Ein echter „buddy“, der stets noch eine Idee mehr anbietet, immer sachlich-freundlich zur Seite steht und dabei hilft, eigene Ideen weiterzuentwickeln. Doch genau darin liegt auch eine Gefahr: Sprachmodelle werden schnell zum false buddy – ein falscher Partner, der auf den ersten Blick hilfreich erscheint, in Wirklichkeit aber Lernen unterminiert, wenn oberflächliche Rekombination mit inhaltlicher Tiefe verwechselt wird.

Sprachlich glatte Oberfläche statt kognitiver Tiefe

Sprachmodelle erzeugen Texte auf Basis statistischer Wahrscheinlichkeiten. Sie rekonstruieren keine Inhalte aus einem aktiven Verstehensprozess heraus, sondern kombinieren (momentan) sprachliche Muster aus ihren Trainingsdaten. Die Resultate klingen plausibel, sind es aber oft nur oberflächlich. Die Modelle verfügen über keine inhaltliche Urteilskraft, keine kritische Perspektive, keine ethische Einordnung. Wer die KI-Antwort als wahr oder gar wissenschaftlich liest, läuft Gefahr, sich aufs Glatteis zu begeben – auf einen Schein von Tiefe hereinzufallen, der sich bei näherer Analyse als algorithmisch flach entpuppt (aus der Deutschdidaktik lese ich dazu sehr klare Worte). Die sprachliche Klarheit erzeugt eine Illusion von Verständnis, wo keine tiefere Durchdringung vorliegt.

Werden KI-Texte mit „Wissen“ verwechselt, eigene Denkprozesse aufgrund der naheliegenden Express-Lösung höchstens noch auf den schnellen Check von KI-Ergebnissen reduziert oder unterbleibt deren kritisches Hinterfragen, wird aus dem Sparringspartner KI ein false buddy im Lernprozess: Ein Sprachmodell gibt vor zu erklären – ohne selbst verstanden zu haben.

Die Komplikation mit der (KI-)Kompilation

Am Beispiel des Geschichtsunterrichts lassen sich das Auftreten und die Wirkung dieser Problematik besonders gut illustrieren. Die Geschichtswissenschaft unterscheidet traditionell zwischen Quellen und Darstellungen. Generative KI bringt nun eine dritte Kategorie hervor, die Kompilation bzw. Rekombination (Oliver Held in Geschichte Unterrichten, 219/2024): Sie ist weder Quelle noch Darstellung, sondern ein synthetisch erzeugtes Textprodukt, dem empirische Plausibilität (keine nachvollziehbare Quellenarbeit), theoretische Plausibilität (kein analytischer Zugriff auf die Vergangenheit) und normative Plausibilität (KI reflektiert keine Werte) fehlen. Mithilfe der Plausibilitätskriterien von Jörn Rüsen zeigt sich bei näherer Betrachtung: KI-generierte Texte wirken erzählerisch kohärent, bleiben aber inhaltlich leer. Sie simulieren (rekombinieren?) Sinn – sie erzeugen ihn nicht.

Skill-skipping statt Sinnbildung

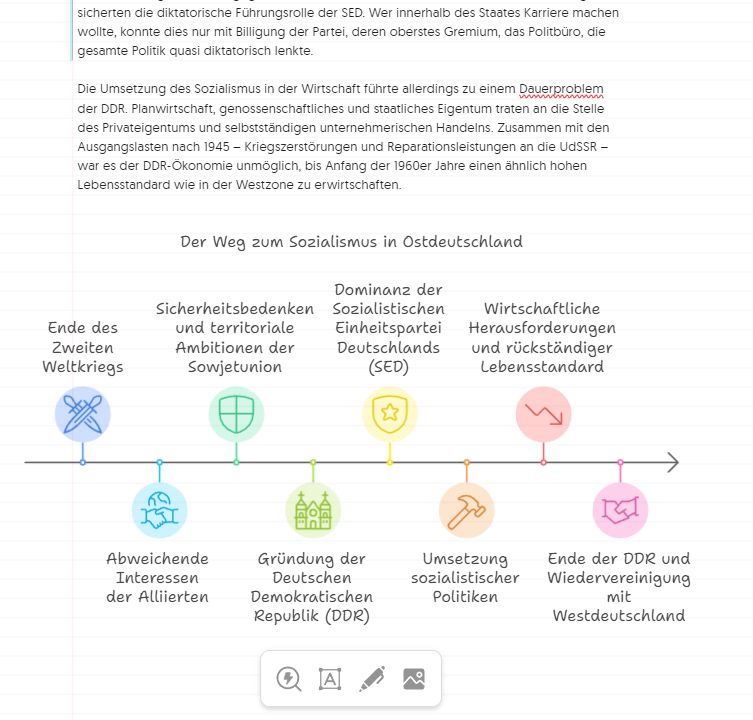

Das mag für manche Schulaufgabe ausreichen, kann für kreative Aufgaben, Textüberarbeitung oder inhaltliches wie sprachliches Feedback auf Lernprodukte eine großartige neue Lernpartnerschaft bedeuten und lernförderlich sein. Besonders kritisch wird der Einsatz generativer KI aber, wenn Lernende ihre eigenen Denk- und Sinnbildungsprozesse durch automatisierte Inhaltsgenerierung ersetzen. Wenn historische Rekonstruktion durch „Prompt + Copy + Paste“ ersetzt wird, verlagert sich Lernen vom aktiven Bemühen und Ringen um Sinn zu einer passiven Übernahme scheinbar plausibler Erklärungen. Das Versprechen von KI(-Tools), schnelle und einfache Antworten auf komplexe Fragen zu geben, verstärkt den Nutzungsreiz und lädt dazu ein, Lern- und Arbeitsschritte zu überspringen. Tools wie NapkinAI, GammaAI oder InfographyAI nehmen uns die lästige Arbeit ab, Informationen noch selber zu recherchieren, individuell zu strukturieren, zu präsentieren (darauf gehe ich im YouTube-Kommentar ausführlich ein – demnächst auch in einem Beitrag zum Geschichtsunterricht).

Insbesondere in gesellschaftsrelevanten Fächern wie Geschichte, Politik oder Ethik ist diese Entwicklung problematisch. Denn hier geht es nicht nur um Fakten, sondern um Deutungen, Wertungen und Sinnbildungsprozesse. Wer diese Prozesse KI-generierten Lösungen überlässt, überspringt wichtige Denk- und Lernschritte, verliert zunehmend die Möglichkeit zur aktiven Auseinandersetzung mit Geschichte und Gegenwart.

Dieses skill-skipping (Florian Nuxoll) mag kurzfristig effizient erscheinen und manche Absurditäten heutiger Aufgabenformate schulischen Lernens widerspiegeln, führt langfristig aber zu deskilling: Deutung und Reflexion, Analyse und Perspektivwechsel – zentrale Ziele moderner Bildung – bleiben auf der Strecke. In einem lesenswerten Blogbeitrag von Michael Gisiger zur „Rolle Künstlicher Intelligenz im Lernen“ verweist der Autor auf die Bedeutung eigenständigen Denkens: „Wird die KI nicht als Werkzeug, sondern als Ersatz für Denken genutzt, untergräbt sie den eigentlichen Kern des Lernens.“

False buddy und Sparringspartner

Eine Herausforderung besteht (momentan) also darin, KI nicht als verlässliche Wissensquelle, sondern als didaktisches Erkenntnismedium zu begreifen. Lernende müssen nicht nur mit, sondern auch über KI lernen: Wie entstehen KI-generierte Texte? Was fehlt ihnen? Inwiefern spiegeln sie dominante Narrative wider und/oder blenden alternative Perspektiven aus? Diese Fragen eröffnen einen reflektierten Zugang zu KI und fördern Medienkompetenz – vielleicht passender: media literacy – im besten Sinne.

Didaktisch ergeben sich daraus unmittelbar ganz unterschiedliche Wege mit Blick auf KI-generierte Inhalte, die besonders im Geschichtsunterricht aktuell relevant sind:

-

- KI-Texte als Ausgangspunkt für kritische Quellenanalyse („Was antwortet ChatGPT zum gleichen Thema heute, was gestern?“).

- Der Vergleich von KI-Kompilationen mit wissenschaftlichen Darstellungen.

- Die Untersuchung von Verzerrungen und Leerstellen in KI-generierten Inhalten.

Aufbauend darauf – da teile ich Michael Gisigers unten zitierte Einschätzung voll und ganz – wird auch in Prüfungsformaten unter den Bedingungen von KI das eigenständige Denken immer bedeutender:

„Dazu gehört auch die Entwicklung von Prüfungsformaten, in denen eigenständiges Denken sichtbar wird – jenseits von automatisierbaren Produkten. Das bedeutet konkret: Lernaufgaben und Prüfungen sollten so gestaltet sein, dass sie nicht lediglich reproduktives Wissen abfragen, sondern Denkprozesse, Argumentationsfähigkeit, Transferleistung oder kreative Problemlösungen erfordern. KI kann dabei als unterstützendes Werkzeug dienen – etwa zur Ideengenerierung, zum Vergleich von Lösungswegen oder zur Reflexion –, darf aber nicht die eigentliche kognitive Leistung ersetzen. Entscheidend ist, dass Lernende aufzeigen, wie sie zu einem Ergebnis gelangt sind – nicht nur, dass sie eines präsentieren.“

Zugleich liegt eine Stärke generativer KI ganz offensichtlich darin, mit entstehenden Ideen und Texten oder existierenden Textkorpora zu arbeiten, uns bei der kreativen Ideenfindung und konkreten Überarbeitung zu unterstützen, kriteriengeleitetes Feedback ruhig, freundlich und sachlich zu geben. Es ist nur folgerichtig, dass die KMK in ihren „Handlungsempfehlungen zum Umgang mit KI in schulischen Bildungsprozessen“ diesen und andere Aspekte aufgreift. Denn hier kann die mathematische Logik des Sprachmodells – das zeigen auch die Erfahrungen in der Unterrichtspraxis – schon jetzt ihre Stärken ausspielen.

Dieser entscheidende Unterschied ist vielen Lernenden noch gar nicht bewusst.

Kurz: Der false buddy kann zum Sparringspartner werden – wenn wir lernen, ihn als solchen zu erkennen und im richtigen Kontext richtig zu nutzen. Kein Lernen mit KI ohne Lernen über KI.

[…] hat sich in einem Beitrag auf seiner Homepage mit „KI als „False Buddy““ beschäftigt: https://unterrichten.digital/2025/04/29/ki-false-buddy-skill-skipping-deskilling/.Bis zum 10. Oktober kann man sich noch für den KI-Schulpreis (Telekom- und Schwarz-Stiftung) […]

[…] Das menschliche Gehirn hat ca. 100 Milliarden Nervenzellen, die über ca. 100 Billionen Synapsen miteinander verbunden sind. Jede Nervenzelle kann mit cal 10.000 anderen Nervenzellen verbunden sein. Wohlgemerkt kann. Wenn nichts, wenig oder immer weniger passiert, dann werden diese Verbindungen wieder aufgelöst. Warum sollte sich das Gehirn auch unnötig Arbeit machen.Mit einem Fachtermini nennt man diesen Abbau kognitiver Leistungen auch Deskilling [2] [3] [4]. […]