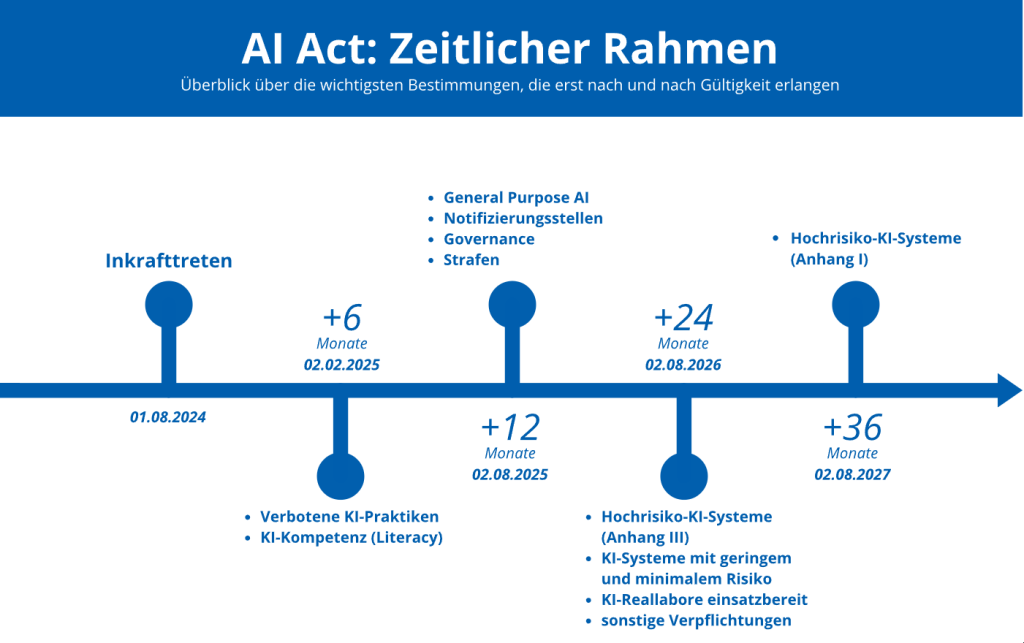

Mit dem im Mai verabschiedeten AI Act trat ab dem 02. August 2024 das weltweit erste Regelwerk für den Einsatz von Künstlicher Intelligenz in der EU in Kraft. Die Anwendung des Gesetzes folgt einem stringenten Zeitplan, der eine stufenweise Umsetzung und klar benannte Schritte vorsieht – Schritte, die für den besonders sensiblen Bildungsbereich, und damit ganz konkret für Schule und Unterricht, wichtig werden. Dabei ist zu beachten: Der AI Act ist eine EU-Verordnung und gilt in allen Ländern der EU – eine Übertragung in deutsches Recht bzw. in bundeslandspezifische Regelungen (analog zur DSGVO) steht noch aus. Dieser Blogbeitrag enthält all diejenigen Aspekte, die mir aus Sicht der Schulpraxis besonders wichtig erscheinen.

Eins vorweg und ganz persönlich: Als Lehrer, Fortbilder und Schulentwickler freue ich mich über diese Gesetzgebung, die einen sicheren und vor allem chancenorientierten Rahmen bietet. Beides ist für gute Bildung wichtig. Denn ich verstehe den AI Act mit seinem risikobasierten Ansatz vor allem als große Chance und Motivation, mit Blick auf den KI-getriebenen Wandel technologische Offenheit und ethische Grundsätze miteinander zu verbinden!

Zielsetzung des AI Acts – Wettbewerbsregulierung und hohes Schutzniveau

Der AI Act ist angesichts ungezügelter Entwicklung von Technologie und Märkten in erster Linie als ein Instrument zur Wettbewerbsregulierung im dynamischen KI-Umfeld konzipiert, das zugleich auf ein hohes Schutzniveau seitens der Anbieter von „KI-Systemen“ (Art. 3, Abs. 1 Lit 1) abzielt – ohne hier zwischen KI-System und KI-Modell zu unterscheiden. So erklärt sich auch die in Artikel 1 formulierte Zielsetzung, „… das Funktionieren des Binnenmarkts zu verbessern und die Einführung einer auf den Menschen ausgerichteten und vertrauenswürdigen künstlichen Intelligenz (KI) zu fördern und gleichzeitig ein hohes Schutzniveau in Bezug auf Gesundheit, Sicherheit und die in der Charta verankerten Grundrechte, einschließlich Demokratie, Rechtsstaatlichkeit und Umweltschutz, vor schädlichen Auswirkungen von KI‑Systemen in der Union zu gewährleisten und die Innovation zu unterstützen“.

AI Act und Schule: KI-Kompetenz als Schlüssel

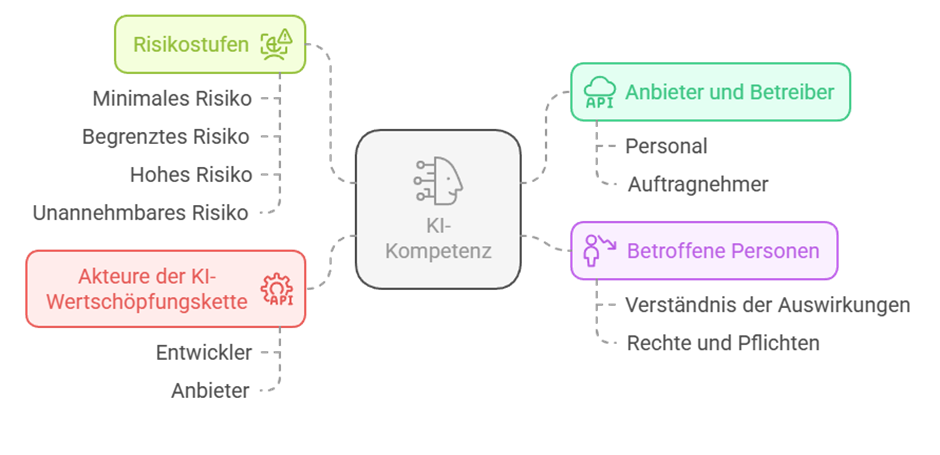

Ein zentraler Bestandteil des AI-Acts ist die Fokussierung von KI-Kompetenz (AI Literacy), die sowohl Anbieter als auch Betreiber von KI-Systemen sicherstellen sollen. Dies umfasst nicht nur technisches Wissen über die Funktionsweise von KI-Systemen, sondern auch die Fähigkeit, Chancen und Risiken kritisch zu bewerten, wie der AI Act in Artikel 3, Abs. 1 Lit 56 definiert:

„Die Fähigkeiten, die Kenntnisse und das Verständnis, die es Anbietern, Betreibern und Betroffenen unter Berücksichtigung ihrer jeweiligen Rechte und Pflichten im Rahmen dieser Verordnung ermöglichen, KI-Systeme sachkundig einzusetzen sowie sich der Chancen und Risiken von KI und möglicher Schäden, die sie verursachen kann, bewusst zu werden.„

Der Gesetzgeber (die Umsetzung in Deutschland steht noch aus) fordert, dass alle am Einsatz von KI beteiligten Personen – ob Entwickler, Betreiber oder Nutzer – ausreichend geschult sein und über ein Grundverständnis, die Fähigkeit zur kritischen Bewertung und praktische Anwendungskompetenzen verfügen müssen.

Kein Grund zur Panik: KI-Kompetenz nach Artikel 4

Für Schulen und Lehrpersonen bedeutet das, dass die bereits seit dem 05.02.2025 geltenden Bestimmungen keinen Grund für Panik darstellen, im Gegenteil. Denn der AI Act gibt in Artikel 4 denkbar offen und nutzungsorientiert vor:

„Die Anbieter und Betreiber von KI-Systemen ergreifen Maßnahmen, um nach besten Kräften sicherzustellen, dass ihr Personal und andere Personen, die in ihrem Auftrag mit dem Betrieb und der Nutzung von KI-Systemen befasst sind, über ein ausreichendes Maß an KI-Kompetenz verfügen, wobei ihre technischen Kenntnisse, ihre Erfahrung, ihre Ausbildung und Schulung und der Kontext, in dem die KI-Systeme eingesetzt werden sollen, sowie die Personen oder Personengruppen, bei denen die KI-Systeme eingesetzt werden sollen, zu berücksichtigen sind.„

Wichtig sind hier zwei Hinweise für Schulen und Lehrpersonen, deren Umsetzung in deutsches Recht ich momentan vermute, nämlich

-

- dass die Anforderungen zur KI-Kompetenz für alle KI-Systeme gelten, ganz unabhängig von der Risikogruppe. Schulen könnten also in jedem Fall gefordert sein, „nach besten Kräften“ aktiv zu werden, sobald KI in irgendeiner Form im Einsatz ist.

- dass Schülerinnen und Schüler aus Sicht der KI-VO bei schulischer KI-Nutzung als „Betroffene“ ebenso über die dafür notwendige „KI-Kompetenz“ werden verfügen müssen – und diese von der Schule als „Betreiber“ anzubahnen ist.

Das ist aber ausdrücklich nur eine persönliche Vermutung / Auslegung – die Umsetzung in nationales Recht steht noch aus! – die ich in dieser Form und ergänzend zu allen Maßnahmen der Anbieter von KI-Systemen durchaus sinnvoll fände.

Persönliche Einschätzung aus Sicht der Schulpraxis

Der Artikel 4 stellt überhaupt keinen Grund zur Panik dar, sondern formuliert eigentlich nur, was aus schulischer Sicht gerade auch mit Blick auf die DSGVO selbstverständlich sein sollte: Dass Schulen als Betreiber von KI-Tools auch die KI-Kompetenz sowohl des Kollegiums als auch der Schülerinnen und Schüler im Blick haben. Für mich würde das den Kreis zur anzubahnenden KI-Kompetenz heutiger Lernender schließen und lässt sich nahtlos verknüpfen mit

- den früh formulierten „4A“ von Prof. Doris Weßels (Akzeptieren, Ausprobieren, Aufklären, Aktiv werden) als Leitlinie für Schul- und Unterrichtsentwicklung,

- der KMK-„Handlungsempfehlung für die Bildungsverwaltung zum Umgang mit Künstlicher Intelligenz in schulischen Bildungsprozessen“, die bereits teilweise in den Ländern umgesetzt wird und

- der DSGVO, nach der sowieso alle einzuführenden Plattformen zu prüfen sind.

Verbote oder Verpflichtungen – Risikoklassen des AI Act

Der EU AI-Act verfolgt einen risikobasierten Ansatz, der es ermöglicht, unterschiedliche Arten von Künstlicher Intelligenz je nach ihrem potenziellen Risiko für Gesellschaft und Individuen zu regulieren. Das Positive daran (im Gegensatz zur „Verbotsverordnung“ DSG-VO) in meinen Augen: KI-Nutzung ist gewünscht und soll gefördert werden, aber eben in einem klaren Rahmen. Auch wenn nur zwei Risikoklassen explizit (Art. 5 – verbotene Praktiken und Art. 6 – Hochrisiko-KI) genannt werden, lassen sich weitergehend auch KI-Systeme mit einem begrenzten Risiko sowie KI-Systeme mit einem minimalen Risiko ableiten, auch wenn die EU im Statement klar macht: „Anwendungen, die nicht ausdrücklich verboten oder als risikoreich eingestuft sind, bleiben weitgehend unreguliert.“ Diese Unterscheidung ist für Schule und Unterricht wichtig – daher schauen wir hier kurz gemeinsam rein.

Kein Risiko / Freie Nutzung mit ausreichender KI-Kompetenz

Für KI-Systeme, die als „kein Risiko“ eingestuft werden, sieht der EU AI Act im Gegensatz zu Hochrisiko- oder sogar Anwendungen mit begrenztem Risiko keinerlei zusätzliche Verpflichtungen vor.

Praxisbeispiel Schule: Im Moment zwar weniger im Fokus, aber zukünftig sicherlich im Bereich Schulleitung und Schulverwaltung ein echtes Thema – KI für Arbeitserleichterung, einfache Prozesse oder Sicherheit: Eine typische Anwendung mit keinem Risiko in einer Schule könnte ein einfacher Spam-Filter in der Schul-E-Mail-Infrastruktur sein. Denn der Spam-Filter, der mithilfe einfacher KI-Algorithmen unerwünschte E-Mails herausfiltert, gilt als risikoarm. Er hat keinen Einfluss auf die Bildung, Entscheidungsprozesse oder Grundrechte der Schülerinnen und Schüler.

Begrenztes Risiko / Erlaubt mit Transparenzpflicht (Art. 50)

Artikel 50 adressiert KI-Anwendungen, die zwar nicht als hochriskant eingestuft werden, aber dennoch in die Kategorie „begrenztes Risiko“ fallen. Bei diesen Systemen sind die Gefahren für Grundrechte und Sicherheit im Vergleich zu Hochrisiko-Systemen geringer. Dennoch verlangt der EU AI Act, dass für diese Anwendungen Transparenzmaßnahmen umgesetzt werden, um die Nutzer darüber zu informieren, dass sie mit einer KI interagieren.

Praxisbeispiel Schule: Eine Schule setzt einen KI-gestützten Chatbot ein, der Schülerfragen beantwortet oder Lerninhalte unterstützt. Obwohl dieses System als „geringes Risiko“ gilt, muss es den Transparenzanforderungen nach Artikel 50 genügen. Das bedeutet, dass in der Benutzeroberfläche klar ersichtlich sein muss, dass der Chatbot von einer KI betrieben wird – etwa durch einen entsprechenden Hinweis oder ein sichtbares KI-Logo. So wissen Schüler und Lehrkräfte, dass die Antworten und Empfehlungen nicht von einem menschlichen Experten stammen, sondern von einem automatisierten System erzeugt werden. Dies unterstützt die kritische Bewertung der Inhalte und trägt dazu bei, eventuelle Fehlinformationen frühzeitig zu erkennen.

Hohes Risiko / Nur mit umfassenden Pflichten (Art. 6)

Nach Artikel 6 sind Hochrisiko-KI-Systeme solche, die in sensiblen Bereichen – wie etwa in der öffentlichen Sicherheit, im Gesundheitswesen oder eben auch im Bildungsbereich – eingesetzt werden und erhebliche Auswirkungen auf die Grundrechte und die Sicherheit der Betroffenen haben können. Der AI Act konkretisiert mit Blick auf Bildung im Annex III, Abs. 1 Nr. 3 die Frage nach Hochrisiko-Systemen:

Für diese Systeme gelten strenge Anforderungen – und das wird sicherlich in nationalem Recht noch deutlich konkretisiert – wie beispielsweise

-

- ein umfassendes Risikomanagement und Qualitätssicherung,

- detaillierte Anforderungen an Daten (qualitativ hochwertige, repräsentative und vorurteilsfreie Daten, um Verzerrungen und Fehlentscheidungen zu vermeiden) und Dateneingabe (Art. 26, Abs. 4),

- Transparenz und Nachvollziehbarkeit des Systems sowie

- menschliche Aufsicht (ein Mensch muss in kritischen Situationen eingreifen und Fehlentscheidungen korrigieren können).

Praxisbeispiel Schule: Eine Schule plant den Einsatz eines KI-Systems zur kontinuierlichen Bewertung von Schülerleistungen – etwa als Unterstützung bei der Notenfindung oder der Identifikation von Lernschwierigkeiten. Aufgrund der weitreichenden Konsequenzen, die fehlerhafte Bewertungen haben könnten (z. B. ungerechtfertigte Benachteiligungen oder falsche Fördermaßnahmen), würde dieses System als hochriskant eingestuft. Gemäß Artikel 6 muss der Anbieter in diesem Fall sicherstellen, dass:

-

-

-

-

- eine Grundrechte-Analyse nach Art. 27 (tritt erst ab 02.08.2026 in Kraft) erfolgt ist,

- das System robust und fehlerresistent ist,

- die zugrunde liegenden Daten regelmäßig auf ihre Aktualität und Korrektheit überprüft werden,

- kompetente (dazu später mehr) Lehrerinnen und Lehrer in den Überwachungsprozess eingebunden werden, um die KI-Entscheidungen zu kontrollieren und im Bedarfsfall einzugreifen.

-

-

-

Inakzeptables Risiko / Verbotene Praktiken (Art. 5)

Verboten sind nach AI Act alle Praktiken, die ein inakzeptables Risiko für die Grundrechte und die Selbstbestimmung des Menschen darstellen. Konkret verboten werden damit:

-

- Manipulative und täuschende Einflussnahme, also die Nutzung unterschwelliger oder absichtlich manipulativer Techniken, um das Verhalten von Menschen zu beeinflussen.

- Ausnutzung von Vulnerabilitäten, also die Schwächen bestimmter Personengruppen – etwa aufgrund von Alter, Behinderung oder besonderer sozialer Situation – auszunutzen, um deren Verhalten zu manipulieren.

- Soziale Bewertung, also der Einsatz von KI zur fortlaufenden Bewertung oder Klassifizierung von Personen (Social Scoring) – etwa durch die Auswertung ihres sozialen Verhaltens – ist ebenfalls untersagt.

- Biometrische Praktiken, also bspw. Daten von Überwachungskameras sammeln sowie der Einsatz von biometrischen Echtzeit-Systemen in öffentlich zugänglichen Räumen, sofern keine strengen Ausnahmeregelungen greifen.

Praxisbeispiel Schule: In Deutschland eigentlich gar nicht denkbar, aber wer weiß: Eine Schule möchte ein KI-System einführen, das in Echtzeit die Emotionen der Schülerinnen und Schüler während des Unterrichts analysiert, um Lehrmethoden anzupassen. Gemäß Artikel 5 ist die Ableitung von Emotionen in Bildungseinrichtungen grundsätzlich verboten. Ein solcher Einsatz würde in die Privatsphäre der Lernenden eingreifen und könnte zu einer diskriminierenden Bewertung oder Überwachung führen.

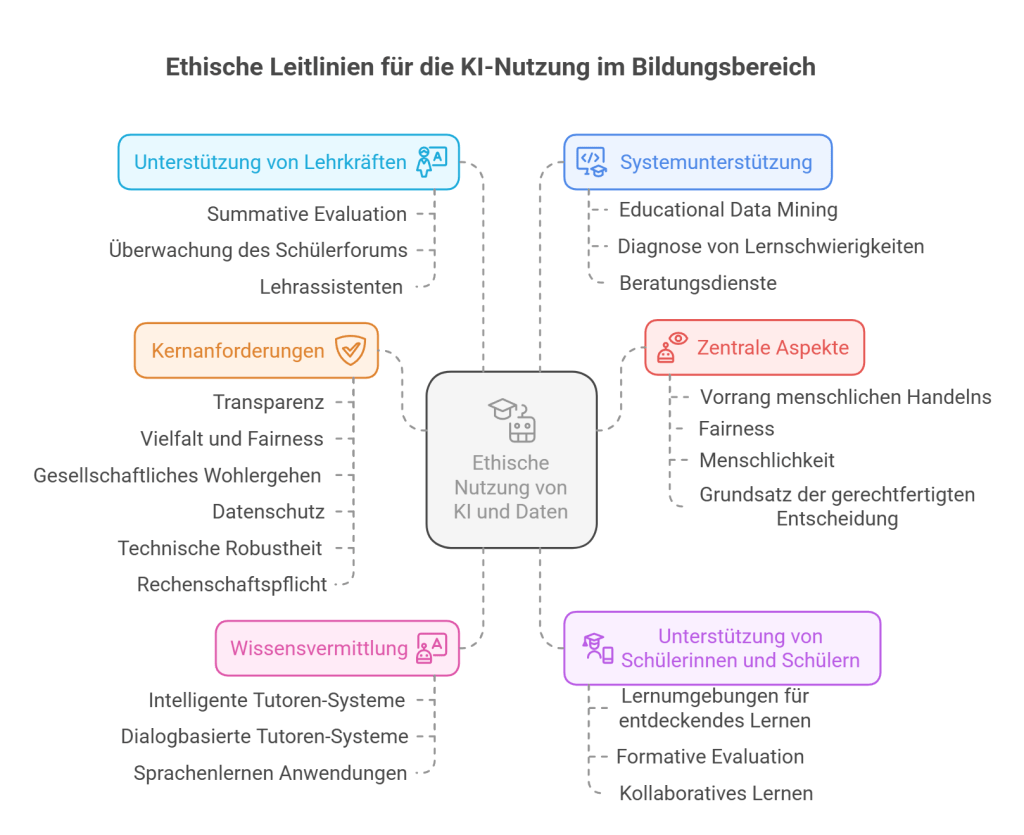

Für Schulen und Lehrpersonen: Ethische Leitlinien für die Nutzung von KI

In einem weiteren Dokument hat die Europäische Kommission bereits 2022 „Ethische Leitlinien zum Einsatz Künstlicher Intelligenz (KI) und von Daten im Unterricht“ veröffentlicht. Der Fokus dieser hilfreichen Handreichung liegt darauf, dass der Einsatz von KI in der Bildung – etwa für

-

- die Wissensvermittlung (mithilfe z.B. Intelligenter Tutoren-Systeme oder Sprachenlernen-Tools),

- die Unterstützung von Schülerinnen und Schülern (z.B. mithilfe von Lernumgebungen oder Formativer Evaluation) oder auch

- die Unterstützung von Lehrkräften (z.B. Summative Evaluation oder Lehrassistenten) genauso wie

- für die Systemunterstützung (z.B. Diagnose von Lernschwierigkeiten oder für Beratungsdienste)

– sowohl Chancen als auch Risiken birgt. Im Kern fordern die Leitlinien einen verantwortungsvollen Umgang mit KI, der auf vier zentralen Aspekten basiert, von denen insbesondere einer entscheidend wichtig erscheint: Der Vorrang menschlichen Handelns, also die Unverzichtbarkeit menschlicher Aufsicht und Entscheidungsfreiheit, um pädagogisch sinnvolle und empathische Lernumgebungen zu gewährleisten. In der folgenden Grafik habe ich versucht, die zentralen Aspekte zu strukturieren.

AI Act & Schule: Herausforderungen und notwendige Maßnahmen

Mit Blick auf die KI-VO – und das erscheint aus der Perspektive innovativer Unterrichtsentwicklung nun vielleicht etwas nüchtern und „unromantisch“, aber so ist das mit Schulrecht nunmal – stehen wir also vor allem vor drei zentralen Herausforderungen (die mir aber gut lösbar erscheinen!):

-

- Schulung des Personals:

Schulen müssen sicherstellen, dass Lehrkräfte, Verwaltungsmitarbeiter und IT-Personal über das notwendige Basiswissen und praktische Kompetenzen im Umgang mit KI verfügen. - Transparenz und Datenschutz:

Der EU AI-Act fordert, dass der Einsatz von KI transparent erfolgt. Dies ist in Schulen besonders wichtig, um das Vertrauen von Schülerinnen und Schüler und insbesondere von Eltern und der Öffentlichkeit zu gewährleisten. Klare Regeln, eine umfassende Dokumentation der eingesetzten Systeme und auf Offenheit abzielende Elternarbeit (Infoschreiben, Elternabende, offene Kommunikation) sind mehr denn je unabdingbar. - Integration in den schulischen Bildungsauftrag:

Ein Grundverständnis von KI und deren ethischen, gesellschaftlichen und technischen Aspekten sollte in der Schule ganz selbstverständlich vermittelt werden – damit Schülerinnen und Schüler im besten Fall selbstständig und kritisch mit diesen Technologien umgehen können. Hierzu möchte ich insbesondere auf meinen letzten Blogbeitrag „Lernen und KI – vom Hype zur Didaktik“ hinweisen, in dem ich Entwicklungslinien zur Integration und Reflexion von KI in Schule und Unterricht aufzeige. Das Lernen mit und über KI sollte zunehmend zur Selbstverständlichkeit werden!

- Schulung des Personals:

AI Act & Schule: Praktische Umsetzung – Erste Schritte für Schulen

Bestandsaufnahme und Bedarfsanalyse

-

- Status quo – wo stehen wir jetzt?: Vermutlich vorerst der einfachste Punkt, aber jede Schule sollte zunächst ermitteln bzw. sammeln, welche KI-Systeme bereits genutzt werden oder geplant sind einzuführen. Aber schon hier können Schulen differenziert vorgehen und die KI-VO (pädagogisch) differenziert interpretieren: Nach der engen (und offiziellen) Auslegung gilt es nur aufzuführen, welche KI-Plattformen seitens der Schule (aktiv) für das Lernen mit KI genutzt werden. In der weiteren Ausführung können Schulen (in der breiteren Auslegung ihrer pädagogischen Verantwortung) natürlich auch bspw. von den Schülern genutzte KI-Tools sammeln und zum Gegenstand des Lernens über KI machen.

-

- Reflexion und Planung – wo wollen wir hin? Schulinterner Austausch mit allen Gruppen der Schulgemeinschaft ist entscheidend für die Frage, in welche Richtung die Schulentwicklung (mit Blick u.a. auf KI) gehen soll. Dafür ist gerade angesichts des momentanen Hypes ein systematisches Vorgehen hilfreich, also Diskussion und Reflexion und vor allem: Das Sammeln praktischer Erfahrungen durch Ausprobieren. In den Blogbeiträgen „Schulleitung in Zeiten von KI (3I-Modell)“ und „Lernen und KI – vom Hype zur (kritischen) Didaktik“ habe ich dazu verschiedene Vorschläge gemacht und stelle Materialien für die schulinterne Arbeit zur Verfügung.

- Bedarfsanalyse: Nach wie vor und vermutlich auch weiterhin äußerst heterogen: Der Wissensstand und der Schulungsbedarf bspw. des Kollegiums als Ausgangspunkt weiterer Überlegungen. Dabei sollten auch die unterschiedlichen Rollen – von der Schulleitung über Lehrkräfte bis hin zu IT-Mitarbeitern, genauso wie Schülerinnen und Schülern – berücksichtigt werden.

Entwicklung eines Fortbildungskonzepts

Bevor die Umsetzungen des AI Acts als Landesgesetze greifen, sollte vorerst ein ausgewogener Mix an Fortbildungsmaßnahmen vorgesehen werden, der Kolleginnen und Kollegen einen ersten genauso wie vertiefenden Einblick in Funktionsweise und Wirkung von KI ermöglichen kann. Ob die hier genannten Maßnahmen künftig den nationalen Umsetzungen des AI Act mit Blick auf Schulen entsprechen, ist noch völlig offen:

-

- Online-Fortbildungen: Seit Jahren bewährt haben sich niedrigschwellige Online-Kurse, Workshops und Informationsveranstaltungen, die grundlegende Kenntnisse über KI vermitteln, bewährt. Gerade für den Einstieg und als erste Vorbereitung bspw. auf einen Pädagogischen Tag eignet sich z.B. die empfehlenswerte Fortbildungsreihe von fobizz „KI-Kompetenz & AI Act“. Mit Prof. Doris Weßels (Grundlagen), Patrick Bronner (Didaktik) und Antonia Dufeu (Rechtsanwältin) erhalten Kolleginnen und Kollegen eine umfassende und spezifische Fortbildung, die mit einem Zertifikat anschließend in der Schule dokumentiert werden kann (und auch seitens der Schule als Nachweis stattgefundener Fortbildung dienen kann). Ob diese Maßnahmen in Zukunft ausreichen, ist angesichts der ausstehenden Umsetzung in deutsches Recht natürlich fraglich.

-

- Pädagogische Tage / SchiLfs: Schulen sollten, im Optimalfall in Zusammenarbeit mit erfahrenen Fortbildnern, regelmäßig Fortbildungstage für Ihr Kollegium durchführen. Ein Einführungsvortrag kann einen gemeinsamen Rahmen bilden, den anschließend Workshops fach-/themenspezifisch vertiefen. Vorteil: Hier wird das gesamte Kollegium fortgebildet, anschließend lässt sich darauf aufbauen und zum Thema „Lernen und KI“ weiter arbeiten / reflektieren.

-

- Schulinterne Mini-Fortbildungen: Erfahrungen sammeln – Erfahrungen teilen. In jedem Kollegium versammelt sich eine unglaubliche Expertise, so natürlich auch zum Thema KI. Diesen Schatz sollten Schulen unbedingt nutzen und das niedrigschwellige Format kurzer Mini-Fortbildungen als Erfahrungsaustausch nutzen, im Optimalfall gemeinsam mit Schülerinnen und Schülern. Denn gerade im Entwicklungsfeld KI ist geteilte Professionalität ein wichtiger Hebel für gemeinsame Fortbildung.

-

- Dokumentation: Schulen sollten regelmäßige Evaluationen durchführen und alle Schulungsmaßnahmen (wie die hier genannten) dokumentieren. So lässt sich einfach nachweisen, dass den gesetzlichen Bedingungen Folge geleistet und kontinuierlich zum Thema KI fortgebildet wurde.

Kooperationen und Netzwerke

-

- Interne und externe Partnerschaften: Schulen können von Kooperationen mit Universitäten, Bildungsanbietern und privaten Institutionen profitieren. Gemeinsame Projekte und Erfahrungsaustausch können den Kompetenzaufbau erheblich unterstützen und sind natürlich auch mit Blick auf die KI-VO ein Beleg für schulisches (Fortbildungs-)Engagement. Hier existieren bereits zahlreiche spannende Projekte, die zeigen, dass Partnerschaften für Schulen eine unglaublich spannende und lehrreiche Möglichkeit für den Einstieg ins Thema KI sein können. Beispielhaft sei hier nur das tolle Projekt …

- Schulische Netzwerke: Zum Fortbildungskonzept jeder Schule sollte inzwischen auch gehören, Netzwerke mit anderen Schulen zu bilden. Die Zeit der Einzelkämpfer ist hoffentlich vorbei, sich selbst auf Kosten anderer Schulen (gerade in Städten mit mehreren Schulen oft ein Thema) zu profilieren, wäre bei diesem Thema unkollegial und fahrlässig. Denn am Ende sitzen wir alle im selben Boot und sollten nicht vergessen: Es geht um die Bildung der Kinder und Jugendlichen genauso wie der Kollegien – und nicht um persönliche Eitelkeiten! Das können wir uns beim Thema KI nicht mehr erlauben! Also gilt es sich spätestens jetzt zusammenzuschließend, Schulnetzwerke zu bilden, gemeinsam Fortbildungen zu planen (hier in Göttingen habe ich tolle Beispiele erlebt und mitgestalten dürfen), Erfahrungen auszutauschen und auch ggü. Schulträgern gemeinsam aufzutreten.

- Bildungsplattformen: Ebenso kann natürlich auch an jeder Schule eine kuratierte Sammlung guter Info-Plattformen ausgehängt und ggf. auch zum Gegenstand von Mini-Fortbildungen gemacht werden: Mit dem KI-Campus, dem Deutschen Bildungsserver – KI, Deutsches Schulportal oder auch dem Themenportal für Schulen Bildung.Digital der DKJS uvm. stehen informative und hilfreiche Portale allen interessierten Lehrpersonen zur Seite – und KI macht Schule bietet als gemeinnützige Organisation sogar Online-Materialien/-Kurse genauso wie Präsenzveranstaltungen für Lehrpersonen wie Schülerinnen und Schüler an.

Kurzfazit (vor Umsetzung durch Bund und Länder) und Zeitplan

Ich bleibe auch nach systematischem Betrachten des AI Act / der KI-VO bei meiner ersten Einschätzung: Als Lehrer, Fortbilder und Schulentwickler freue ich mich über diese Gesetzgebung, die einen sicheren und vor allem chancenorientierten Rahmen bietet. Beides ist für gute Bildung wichtig. Denn ich verstehe den AI Act mit seinem risikobasierten Ansatz – insbesondere als Ergänzung der DSGVO, die weiterhin Grundlage aller Planungen und Vorhaben bleibt – vor allem als große Chance und Motivation, mit Blick auf den KI-getriebenen Wandel technologische Offenheit und ethische Grundsätze miteinander zu verbinden!

Ein Punkt ist mir aber aufgefallen: Gerade der in Schule und Unterricht momentan vorherrschende Wildwuchs an unterschiedlichsten KI-Apps, die in die unteren Risikostufen fallen, wird auch durch den AI Act nicht reguliert. Dieser rechtliche Rahmen zielt vor allem auf Risikobereiche ab. Das ist wichtig und richtig und verhindert Missbrauch von KI. Nun bleibt es aber interessant zu sehen, ob nicht auch auf niedrigeren Risikostufen eine auf KI fokussierte Regulierung notwendig sein wird – denn große Teile der momentan genutzten „KI“ fallen nur mittelbar unter den AI Act (Transparenz). Da sollten wir dran bleiben.

Auch hier bleibt wieder eine Erkenntnis: Fortbildung ist in Zeiten schnellen Wandels und neuer Herausforderungen essentiell – ob als Schulgemeinschaft oder individuell als Lehrperson. Hier sind die Länder gefordert.

Und für alle Schulen, Schulleitungen oder Kolleginnen und Kollegen: In Kürze werde ich hier auch eine Art Leitfaden bzw. „Vorabinfo AI Act“ veröffentlichen, die Schulen bspw. als Poster im Lehrerzimmer oder als Arbeitsvorlage für interne Fortbildung nutzen können.

Der Zeitplan stellt übersichtlich dar, in welchen Stufen der AI Act in Kraft tritt und welche Regelungen damit verbunden sind: